Los códecs no tienen por qué ser difíciles. No, de verdad, no lo son. Lo único que importa es que elijas el códec adecuado.

Al final de este artículo, serás capaz de elegir el mejor códec para ti en cada proyecto. Mi objetivo es darte lo que necesitas para tomar tus propias decisiones informadas sobre los códecs. Así que usted puede elegir el códec adecuado para usted, en lugar de confiar en lo que funcionó para otra persona.

Voy a caminar a través de cada paso en el proceso de hacer un video. Haga clic en un título para saltar a esa sección. Voy a cubrir:

- El códec que filmas

- El códec que editas

- El códec que corriges el color

- El códec que envías a VFX

- El códec que exportas

- El códec que archivas

En cada etapa, te explicaré qué factores debes tener en cuenta a la hora de elegir un códec. También te daré algunos ejemplos de los códecs más utilizados para esa etapa.

En el camino, cubriremos por qué los códecs de gama baja y los códecs de gama alta pueden ralentizar tu edición, las razones para una edición proxy/offline, un paseo por un proyecto del mundo real, algunas estrategias de ahorro de almacenamiento, y una explicación de por qué la transcodificación no puede mejorar tu calidad de imagen.

Los beneficios de optimizar tus códecs pueden ser enormes. Elija el códec adecuado y conservará sus imágenes con la máxima calidad. También puede hacer que tu trabajo sea más rápido, y te permite aprovechar al máximo tu ordenador y tu almacenamiento. Podrás trabajar más rápido en un portátil que muchos en una torre de gama alta.

Qué hace un códec

Un códec es un método para hacer que los archivos de vídeo sean más pequeños, normalmente desechando cuidadosamente datos que probablemente no necesitemos realmente. Y son bastante inteligentes a la hora de hacerlo. Hace unos años, creé un vídeo que cubre las principales técnicas de compresión que utilizan muchos códecs. No es necesario verlo para entender este artículo, pero ciertamente no hará daño.

Cómo funcionan los códecs – Tutorial.

Si te saltas el vídeo, aquí tienes algunas explicaciones muy básicas:

- Submuestreo de croma: Desecha algunos datos de color (4:4:4 no es muestreo de croma. 4:2:2 es algo de submuestreo de croma.4:2:0 es mucho submuestreo de croma). Es malo si estás haciendo corrección de color. Realmente malo si estás haciendo pantalla verde o trabajo de VFX.

- Macro-Blocking: Encuentra bloques (de tamaño variable) de colores similares y los hace todos del mismo color. Malo para los VFX y la corrección de color. Casi todos los códecs lo utilizan en cierta medida, y la cantidad tiende a variar con la tasa de bits.

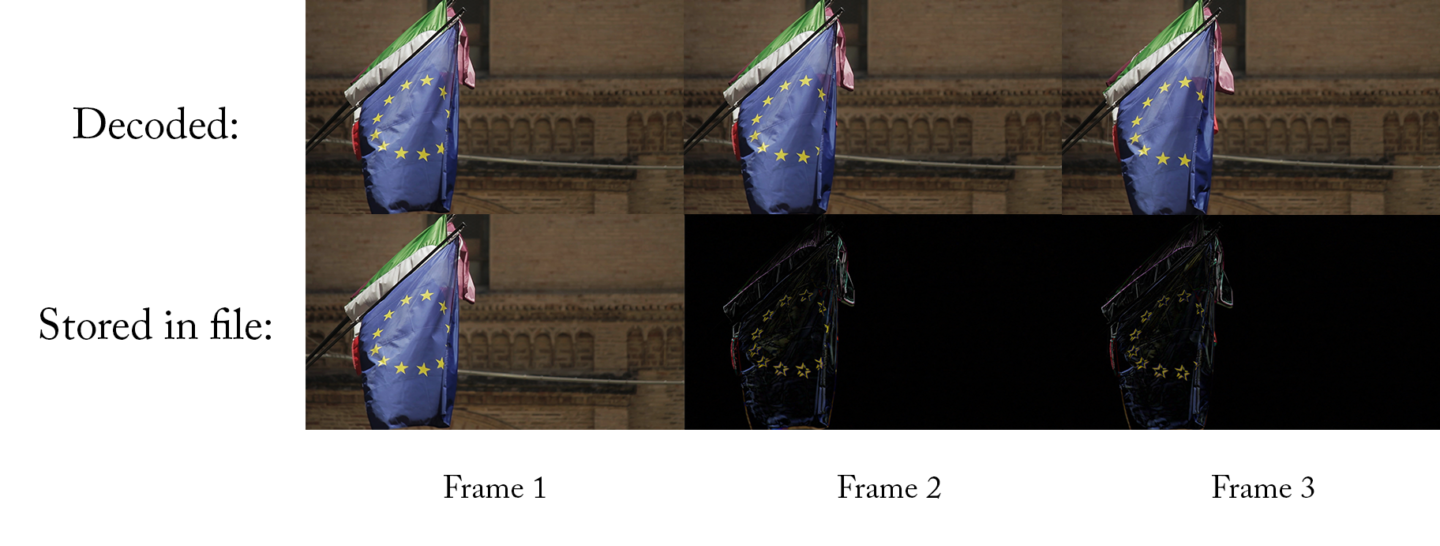

- Compresión temporal: Utiliza los fotogramas anteriores (y a veces los siguientes) para calcular el fotograma actual. Mala para la edición.

- Profundidad de bits: El número de colores posibles. Una mayor profundidad de bits (números más grandes) es buena para la corrección de color y los efectos visuales.

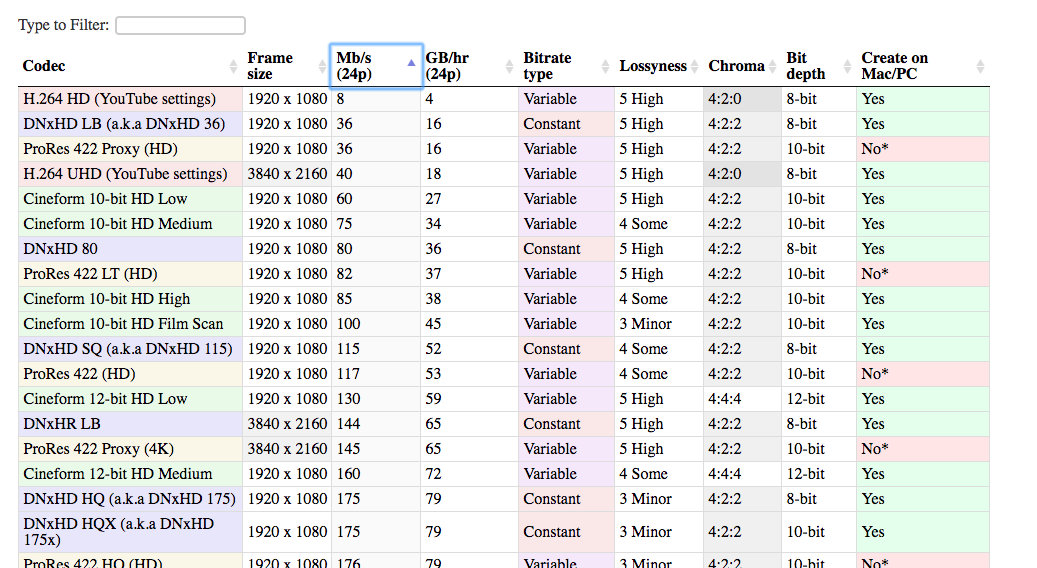

Tabla de comparación de códecs

También he elaborado una lista de todos los códecs más comunes utilizados en el mundo de la postproducción. Esta lista puede ayudarte a comparar diferentes códecs entre sí y tomar la mejor decisión para tu proyecto.

Hay muchos códecs diferentes que se pueden utilizar en el proceso de edición. Los que he incluido son, con mucho, los más comunes. Hay una ventaja significativa para el uso de códecs populares. Es más probable que funcionen en tu sistema, en el de tu cliente, en el de dentro de cinco años, etc. Y es más fácil encontrar ayuda si algo va mal.

Abre la tabla en una nueva pestaña. Así podrás comparar los códecs mientras lees el artículo.

Mira la tabla

Pérdida

Una de las columnas de la tabla es la «pérdida», que es un concepto importante con los códecs. Cuando hablo de pérdida, no me refiero necesariamente a lo que ve el ojo. Me refiero a la cantidad de datos que retiene el códec, de los que sólo puedes ver una parte. La pregunta es: si tengo una imagen sin comprimir y luego la comprimo con este códec, ¿qué similitud tendría la nueva imagen con la anterior? ¿Cuánta información se pierde en la transcodificación? Si las dos imágenes son muy similares, entonces el códec no tiene muchas pérdidas. Y si son muy diferentes, entonces es más lossy.

La lossyness es una combinación de las técnicas que el códec particular utiliza y su bitrate. Un códec con más pérdidas no es necesariamente malo. En algunos casos (cuando se ve en línea, por ejemplo), no es necesario conservar el 100% de la imagen original. El uso de un códec con más pérdidas puede ser un movimiento muy inteligente debido a la cantidad de espacio que ahorra.

Si la imagen se ve igual de bien para mi ojo, entonces ¿por qué debería importarme si es técnicamente ‘con pérdidas’?

Debería importarle porque puede querer cambiar la imagen. Si usted está haciendo cualquier tipo de corrección de color, entonces usted va a cambiar la imagen. El resultado puede ser que vea elementos de la imagen que no eran visibles (o prominentes) cuando la capturó.

Por ejemplo, aquí hay una imagen que fue capturada en bruto.

Aquí hay una captura de pantalla de la misma comprimida con H.264, usando una configuración estándar recomendada por YouTube.

Y luego comprimido con DNxHD 350x:

Todos se ven más o menos igual, ¿no? La calidad visual es casi la misma, y el archivo H.264 es una fracción del tamaño del archivo DNxHD. Por eso es la configuración recomendada para YouTube. Se ve igual de bien a la vista, y el archivo es mucho más fácil de subir a Internet.

El problema con la versión H.264, sin embargo, viene cuando intentas hacer cambios en la imagen. ¿Qué pasa si quieres aumentar la exposición?

Ahora podemos ver donde la imagen altamente comprimida se desmorona. Su pelo y su camisa tienen un aspecto terrible en la imagen h.264, y los edificios junto al río tienen un aspecto pastoso.

Por eso es por lo que realmente quiere un códec de alta calidad cuando capture la imagen. Porque probablemente querrás hacer cambios más adelante, pero aún no sabes cuáles podrían ser esos cambios. Querrás ajustar el color y el contraste, tal vez ajustar la velocidad, tal vez añadir algunos VFX. Un archivo muy comprimido no permite realizar esos cambios sin descomponerse.

Por eso es una buena idea capturar el material en 10 bits, aunque al final se obtenga un archivo de 8 bits. No sabes, cuando filmas, qué bits vas a querer.

El viaje de los códecs

Ahora es el momento de recorrer las diferentes etapas que encontrarás en cada proyecto.

Todo proyecto comienza con un códec que capturas en la cámara. Y termina con un códec que exportas (delivery codec) y entregas a tu cliente o subes a la web. En el caso más sencillo, haces toda la edición y corrección de color directamente en los archivos de la cámara. Luego exportas a tu códec de entrega, por lo que sólo utilizas dos códecs.

Pero la mayoría de las veces se complica un poco más. Puedes transcodificar a un códec diferente para la edición, y potencialmente para la corrección de color, y definitivamente para los efectos visuales. Pero todo comienza con…

El códec con el que filmas

(volver al índice)

Este es tu códec de captura, (también llamado «códec nativo de la cámara» o «códec de adquisición»).

En general, deberías apuntar al códec de mayor calidad que tu cámara (o tu presupuesto) pueda capturar. Cuando digo «máxima calidad», me refiero a que quieres capturar la mayor cantidad de información posible. Por lo tanto, es necesario utilizar códecs con menos pérdidas: menos compresión, mayor profundidad de bits y menos submuestreo de croma. Cuanta más información tengas al capturar, más flexibilidad tendrás después. Especialmente en la corrección de color y en los efectos visuales (si los haces).

Por supuesto, también tienes que considerar muchos otros factores prácticos en esta decisión. De lo contrario, siempre estaríamos grabando 8K en bruto, ¿no?

Coste

La primera consideración es obviamente el coste. En general, cuanto más cara es la cámara, mayor es la calidad de los códecs disponibles en ella. Digo en general porque hay algunas cámaras de «punto dulce» que pueden ofrecer excelentes códecs a un precio razonable. La serie GH de Panasonic (especialmente en los primeros días, cuando la GH2 fue pirateada) era conocida por ofrecer mejores códecs que las otras cámaras de su rango de precios.

Consejo: mejores códecs con grabadores externos

Una forma de capturar códecs de mayor calidad en cámaras más baratas es utilizar un grabador externo.

Estos dispositivos (muchos de los cuales pueden doblar como monitores externos) toman una señal sin comprimir de la cámara, a través de HDMI o SDI, y la comprimen por separado. Así que terminas con dos copias de tu material. Una copia fuertemente comprimida en la cámara y una segunda copia ligeramente comprimida en la grabadora externa. La clave aquí es que la cámara envía la señal a la grabadora antes de comprimirla.

Una nota importante aquí es que muchas cámaras más baratas sólo emiten 8 bits, y a menudo no en 4:4:4. Un grabador externo podría ser capaz de comprimir a un códec de 12 bits. Pero si la cámara sólo envía 8 bits, la grabadora sólo puede grabar 8 bits. Es posible que algunas cámaras más baratas no emitan una señal HDMI «limpia» que sea adecuada para la grabación. Llamamos «limpia» a una señal de salida cuando es sólo la imagen pura sin superposiciones de la interfaz de la cámara.

Almacenamiento

El segundo factor a considerar es el espacio de almacenamiento. Los códecs de alta calidad tienden a ser de mayor tasa de bits, lo que significa que los archivos son más grandes. Tienes que estar preparado para almacenar y hacer copias de seguridad de todos esos archivos a medida que vas grabando. Además, es posible que tengas que actualizar tus tarjetas de memoria para poder grabar los datos de alta tasa de bits. Si grabas en solitario, puede que acabes eligiendo un códec de menor calidad porque te permite cambiar las tarjetas de memoria con menos frecuencia.

Acabado

Otro factor a tener en cuenta es la cantidad de corrección de color y efectos visuales (denominados colectivamente como acabado) que piensas hacer. Si la corrección de color es mínima y no hay efectos visuales, es probable que se pueda utilizar la menor profundidad de bits, el submuestreo de croma y el bloqueo de macros que ofrecen los códecs de captura de menor calidad.

Hardware de edición

El último factor a tener en cuenta es la máquina de edición. La mayoría de los códecs de captura no son adecuados para la edición sin un ordenador de alto rendimiento. El H.264 y algunos archivos en bruto requieren una potente CPU/GPU para editarlos sin problemas. Y los códecs de muy alta velocidad pueden requerir discos duros o servidores de datos de alta velocidad. A menos que estés grabando con un códec fácil de editar, es posible que tengas que transcodificar tus archivos a otro códec antes de editarlos. Y esto puede llevar tiempo. Para algunos, la transcodificación del material no es un gran problema porque puede hacerse de un día para otro o en un ordenador libre. Sin embargo, si trabajas con plazos de entrega muy ajustados, puedes elegir un códec que te permita empezar a editar inmediatamente después del rodaje, aunque eso suponga un mayor coste o un sacrificio en la calidad de la imagen. En la siguiente sección explico qué códecs son los mejores para la edición.

El códec con el que editas

(volver al índice)

De acuerdo, has rodado tu película y tienes todos los archivos en tu ordenador. Ahora tienes que decidir si vas a editar con estos archivos. O si quieres transcodificar a otro formato.

¿Por qué debo transcodificar antes de editar? ¿No puedo simplemente editar los archivos que salieron de la cámara?

Bueno, depende. Prácticamente todos los principales paquetes de software pueden ahora editar cualquier códec que su cámara crea. (A no ser que seas un malote disparando con una cámara nueva con tecnología nueva). Pero mientras que casi siempre es posible editar los códecs que su cámara disparó, no es siempre la mejor idea.

Si usted tiene la suerte de estar disparando en un códec que es grande para la edición, puede omitir este paso.

Para muchos de nosotros, sin embargo, el códec de captura no va a ser optimizado para la edición. Hay dos factores principales que debes tener en cuenta a la hora de elegir tu códec de edición: el tipo de compresión y la tasa de bits.

Los códecs de alta compresión pueden ralentizar tu edición

(volver al índice)

La mayoría de las cámaras de gama baja y media graban con códecs que utilizan la compresión temporal, también conocida como compresión long-GOP. Aquí te daré una explicación sencilla, pero si te interesa aprender con más detalle, mira mi vídeo sobre códecs, que empieza en el minuto 19:00.

La explicación sencilla de un long-GOP es que, para cada fotograma, el códec sólo captura lo que ha cambiado entre este fotograma y el anterior. Si el vídeo no incluye mucho movimiento, entonces el nuevo archivo puede ser MUCHO más pequeño. La diferencia entre este fotograma y el anterior es de sólo unos pocos píxeles. Así que todo lo que necesitas almacenar son unos pocos píxeles. Eso es genial!

Siempre hacia adelante

El problema, sin embargo, es que estos códecs sólo tienden a funcionar bien cuando se reproducen hacia adelante. (Si tienes curiosidad por el motivo, echa un vistazo al vídeo). Eso está muy bien para ver en YouTube y en tu reproductor de DVD, pero no está bien para editar. Cuando estás editando, a menudo estás saltando de un lado a otro, o reproduciendo un clip hacia atrás. Y se necesita mucha más potencia de procesamiento para hacer esas cosas rápidamente con un códec de GOP largo. Un ordenador de gama alta puede no tener problemas, pero incluso un ordenador de gama media se retrasará y tartamudeará cuando se hojee el material rápidamente o se salte de un lado a otro.

Los códecs que no son long-GOP (también conocidos como códecs intra-frame), pueden reproducirse hacia atrás con la misma facilidad que hacia delante. Así que incluso un ordenador de gama media puede saltar de un lado a otro con mucha fluidez. Si sólo has editado clips directamente desde la cámara, puede que no te des cuenta de lo que te estás perdiendo.

La otra cosa que puede causar problemas con la reproducción es el vídeo en bruto. El vídeo sin procesar necesita ser convertido antes de poder ser mostrado (algo así como un códec). Y algunos ordenadores no pueden decodificar el archivo en bruto lo suficientemente rápido, especialmente si es 4K. Irónicamente, ¡tanto las cámaras de gama baja como las de gama alta producen archivos difíciles de editar!

Los códecs de alta tasa de bits pueden ralentizar la edición

(volver al índice)

Para los códecs de gama baja y media, no hay que preocuparse en absoluto por las tasas de bits. Sin embargo, una vez que empiezas a subir de nivel, los códecs de alta tasa de bits pueden causar problemas de edición, especialmente si trabajas en ordenadores de uso cotidiano.

La razón es que tu ordenador tiene que ser capaz de leer los datos de tu disco duro a una tasa de bits que sea al menos tan alta como la de tu códec. Tiene sentido: si tu códec es de 50Mb/s (cincuenta megabits por segundo), tu ordenador tiene que ser capaz de leer ese archivo desde tu disco duro a 50Mb/s o, de lo contrario, se quedará atrás y se atascará.

(ten en cuenta que Mb/s significa megabits por segundo, mientras que MB/s significa megabytes por segundo. Hay ocho bits en un byte, por lo que hay que multiplicar por 8 al convertir de MB/s a Mb/s)

Algunas buenas noticias

La buena noticia es que los discos duros son cada vez más rápidos. Así que 50Mb/s nunca van a causar ningún problema. Pero, ¿qué pasa si estás editando ProRes 422HQ a 4K, que son 734Mb/s? El disco duro externo medio es apenas lo suficientemente rápido para reproducirlo. Algunos discos duros más baratos no lo consiguen en absoluto. Y luego, ¿qué pasa si estás editando una multicámara con tres cámaras? De repente necesitas el triple de velocidad de datos: ¡2.202 Mb/s! En ese momento, vas a tener que invertir en algunos discos duros de alto rendimiento o RAIDs.

Aquí hay algunas directrices aproximadas para las velocidades de almacenamiento de datos comunes. (Siempre habrá ciertos modelos que rindan menos o más.)

- Disco giratorio estándar: 100-120MB/s

- Unidad giratoria profesional: 150-200MB/s

- Unidad SSD estándar: 400-500 MB/s

- RAID de gama baja: 200-300 MB/s

- RAID de gama alta: 1000-2000 MB/s

Disparar en el registro puede ralentizar la edición

Disparar en el registro es una forma de preservar la mayor parte posible del rango dinámico. Esto permite una escena que tiene luces brillantes y sombras oscuras sin soplar las luces o aplastar los negros. Las altas luces son un efecto secundario especialmente desagradable cuando se graba en vídeo en lugar de en película. Por eso, rodar en formato de registro puede ayudar a que tus grabaciones sean más cinematográficas. Ahora que los perfiles de registro están disponibles incluso en la mayoría de las cámaras prosumidoras, es una forma muy popular de trabajar.

La desventaja

La desventaja es que la imagen que sale de la cámara no se ve tan bien. Tendrás que añadir contraste y saturación para acercarte siquiera a la imagen final. La forma más común de hacerlo es añadir una LUT a tu material. Esto es esencialmente una simple corrección de color preestablecida que devuelve a tu material un aspecto «normal».

Si estás rodando en un espacio de color de registro, entonces necesitas aplicar una LUT a tu material para poder previsualizarlo con un color y contraste normales. Esto significa que su editor tendrá que aplicar la LUT apropiada a todos los clips durante la edición. Esto puede ser molesto de manejar, y también puede ralentizar un poco el ordenador. Esto se debe a que primero tiene que decodificar cada fotograma y luego aplicar la LUT antes de mostrarlo. Es posible editar el material de archivo sin ninguna LUT, pero no es lo ideal. El color de dos tomas puede influir en la forma de intercalarlas.

Si vas a transcodificar tus archivos antes de editarlos, entonces puedes aplicar la LUT durante el proceso de transcodificación. De esta manera, el editor siempre está trabajando con material de archivo que tiene buen contraste y color y nunca tiene que molestarse con LUTs. Tenga en cuenta que sólo debe hacer esto si está utilizando un flujo de trabajo Proxy, no un flujo de trabajo Intermedio Directo (descrito más adelante).

Considere el tiempo dedicado a la codificación

La principal desventaja de transcodificar su material antes de editarlo es simplemente el tiempo que se necesita para hacer la transcodificación. Si tienes mucho material que revisar, y tu ordenador no es rápido, puede llevar mucho tiempo. Si no tienes mucha prisa, puedes dejar que la transcodificación se ejecute durante la noche, potencialmente en varios ordenadores si tienes acceso a ellos, pero eso no es siempre lo ideal.

Cuando trabajaba en Khan Academy, nuestro fundador grababa regularmente mensajes de vídeo cortos para enviarlos a la gente. Que a menudo tenían una agenda muy apretada. Normalmente grababa en 4K en formato long-GOP log, y los editaba en un MacBook Pro. La edición de 4K long-GOP con una LUT (para corregir el material de registro) en un portátil significaba que podía reproducir el vídeo sin problemas en Premiere Pro, pero no podía hacer zoom en la línea de tiempo tan rápido como quería sin tartamudear.

Pero eso no me molestaba demasiado porque la edición era extremadamente sencilla. Sólo unos pocos cortes, quizá algo de música, un título, y ya estaba. Aunque mi velocidad de edición no era la ideal, habría gastado más tiempo en la transcodificación de lo que habría ahorrado en velocidad de edición, así que simplemente utilicé los archivos originales.

Sin embargo, si editara una pieza más larga con la misma configuración, transcodificaría a DNxHD o ProRes. Generalmente, haría la mayor parte de la transcodificación durante la noche, a menudo con varias máquinas funcionando al mismo tiempo.

Edición Proxy

(volver al índice)

Si vas a transcodificar los archivos nativos de la cámara antes de editarlos, entonces usarás un códec «intermedio». Se llama intermedio porque viene entre el códec de captura y el de exportación. Hay dos formas comunes de trabajar con códecs intermedios:

La primera es el flujo de trabajo «proxy» o «edición offline». Esto significa que usted está transcodificando su metraje capturado a un formato intermedio, editando con ese formato, y luego volviendo a enlazar con los archivos originales de la cámara antes de exportar. Como vas a utilizar los archivos de la cámara para exportar y no los archivos proxy, no tienes que preocuparte tanto por elegir un códec proxy con gran calidad de imagen: los códecs con pérdidas están bien. Puedes optimizar la velocidad de edición y la comodidad de almacenamiento.

El flujo de trabajo proxy es tan común que muchas cámaras de gama alta graban un archivo raw de gama alta *y* un archivo proxy ProRes o DNxHD al mismo tiempo. Tras el rodaje, se hace una copia de seguridad de los archivos raw y se guardan. Los archivos proxy se envían a los editores y al director/productores para los dailies.

Evite la compresión temporal

Cuando elija un códec proxy, querrá optar por uno que no utilice la compresión temporal (también conocida como compresión entre fotogramas o compresión long-GOP), y querrá elegir uno que tenga una tasa de bits más baja. La baja tasa de bits significa que los archivos son mucho más pequeños, por lo que puedes utilizar menos discos duros, más pequeños y más baratos, simplificando tu flujo de trabajo.

Aunque los archivos proxy son excelentes para la edición, no debería hacer más que una corrección de color básica con los archivos proxy. Si vas a hacer toda la corrección de color dentro de tu software de edición, entonces es mejor volver a enlazar con tus archivos de la cámara porque tus archivos proxy pueden tener una calidad de color inferior.

La buena noticia es que la mayoría de los software de edición de hoy en día pueden cambiar entre los archivos de la cámara y los archivos proxy en sólo un par de clics, por lo que incluso puedes ir y venir si lo necesitas.

Hemos publicado guías detalladas para los flujos de trabajo proxy en cada uno de los principales NLEs:

- Final Cut Pro X Proxy Workflows

- Premiere Pro Proxy Workflows

- Avid Media Composer Proxy Workflows

Algunas buenas opciones de códecs proxy

De lejos, los códecs proxy más comunes son DNxHD/DNxHR y ProRes. Ambos han existido durante años, por lo que son muy ampliamente apoyados. Todo el mundo sabe cómo manejarlos. Ambos son muy adecuados para un flujo de trabajo proxy (ProRes incluso tiene un preset llamado «proxy»), y son casi intercambiables cuando se utilizan para proxies.

DNxHD está hecho por Avid, y ProRes está hecho por Apple. Así que tiene sentido que DNxHD funcione mejor en Media Composer y que ProRes funcione mejor en Final Cut Pro X. Eso solía ser cierto, pero hoy en día ambos códecs funcionan muy bien en todos los editores modernos (incluyendo Premiere Pro). Puede haber un ligero aumento de velocidad al utilizar el códec que fue diseñado para el sistema, pero es muy leve.

La única diferencia significativa entre los dos para un flujo de trabajo proxy es el hecho de que puede tener problemas para crear ProRes en un PC, mientras que DNxHD es muy fácil de crear entre plataformas. La única forma de crear ProRes en un PC que se admite oficialmente es con Assimilate Scratch. Hay otros métodos no compatibles para crear archivos ProRes en un PC, pero no siempre son fiables. Los PCs pueden reproducir y editar fácilmente archivos ProRes, pero no se pueden codificar nuevos archivos ProRes en un PC tan fácilmente como DNxHD, por lo que algunos editores prefieren un flujo de trabajo DNxHD por esa razón.

Elige un carril

Independientemente de cuál de los dos códecs elijas, también tienes que elegir qué sabor quieres. Esto va a depender realmente de sus limitaciones de almacenamiento – es un compromiso entre la calidad de la imagen y el tamaño del archivo. La buena noticia es que no necesitas una calidad de imagen óptima cuando estás editando, así que puedes elegir un códec de baja tasa de bits.

Comienza con el códec ProRes o DNx más pequeño en la misma resolución que tu códec de captura. Mira la columna de GB/hora y multiplícala por el número de horas de grabación que tienes. Si tienes suficiente espacio de almacenamiento, entonces eres bueno – utiliza ese códec. Si tienes mucho espacio de almacenamiento extra, piensa en usar el siguiente más grande.

Pero si no tienes suficiente espacio de almacenamiento, o si estás en una máquina poco potente, entonces baja la resolución un poco. Muchas películas de Hollywood de gran presupuesto se editaban en 480p hace unos años, así que no te preocupes si tienes que bajar la resolución de 4K a 720P para la edición.

Intermedio directo

El otro tipo de flujo de trabajo intermedio es algo que yo llamo Intermedio directo. Esto significa que usted transcodifica sus archivos de la cámara en un códec que es a la vez bueno para la edición y de muy alta calidad (sin mucha pérdida). Como el códec es de muy alta calidad, se conserva casi toda la información original de los archivos de la cámara, por lo que no es necesario volver a enlazar con los archivos de la cámara, sino que se puede exportar directamente desde los archivos intermedios. Habrá una pérdida teórica de información cuando transcodifiques, pero si eliges un códec intermedio lo suficientemente bueno, será lo suficientemente pequeña como para no tener que preocuparte por ello.

(Nota: Estoy llamando a este proceso «Intermedio Directo» porque no hay un nombre común para este flujo de trabajo. La gente suele llamarlo simplemente «intermedio», pero eso puede ser confuso porque los flujos de trabajo proxy también son un tipo de flujo de trabajo intermedio. Algunas personas también llaman a esto un flujo de trabajo «en línea», pero esto también es confuso porque ese término fue creado para describir un flujo de trabajo que incluye una edición en línea y fuera de línea, no un flujo de trabajo que está en línea de principio a fin.)

La preservación es la clave

La clave para elegir un buen códec intermedio directo es asegurarse de que está preservando toda la información de su códec de captura. Un códec intermedio nunca hará que tus imágenes sean mejores (una explicación más detallada a continuación), pero definitivamente puede empeorarlas si eliges el códec equivocado. Lo importante es entender los detalles de tu grabación original y asegurarte de que tu códec intermedio es al menos tan bueno como tu códec de captura en cada área. Si capturas tu material en una DSLR como una Sony A7Sii a 4K, entonces estarás grabando en un códec 4:2:0, 8 bits, Long-GOP a 100Mbps. Quieres un códec intermedio que sea al menos 4:2:0 y 8 bits. Ir más allá de estos valores (por ejemplo, a 4:4:4 y 12 bits) no te perjudicará, pero tampoco te ayudará en absoluto. Así que probablemente no valga la pena el espacio de almacenamiento extra.

Digamos, por ejemplo, que queremos ir con un códec ProRes. Tenemos 4 opciones para elegir que son 4:2:2 y 10 bits.

- 145Mb/s ProRes 422 Proxy

- 328Mb/s ProRes 422 LT

- 471Mb/s ProRes 422

- 707Mb/s ProRes 422 HQ

Superior

Podrías pensar que todo lo que necesitas es igualar el bitrate de la cámara (100Mbps), pero en realidad necesitas superar ampliamente la tasa de bits de la cámara. Esto se debe a que h.264 es un códec mucho más eficiente que ProRes. Dado que h.264 utiliza la compresión long-GOP, puede incluir mucha más información en esos 100 megabits que ProRes. Para que ProRes tenga la misma calidad de imagen que h.264, se necesita una tasa de bits mucho mayor. Yo recomendaría usar sólo ProRes 422 o ProRes 422 HQ si empiezas con un códec h.264 de 100 Mbps. ProRes 422 probablemente estará bien, pero si tienes mucho espacio de almacenamiento, entonces subir a ProRes 422 HQ tendrá una ligera ventaja.

Aunque está bien simplemente igualar la profundidad de bits y el muestreo de color al elegir un intermedio, siempre debes aumentar la tasa de bits al menos un poco. Si vas a pasar de un códec GOP largo a uno que no lo es, entonces deberías aumentar mucho el bitrate.

Nota al margen: Si quisieras ir con DNxHD en lugar de ProRes, tienes opciones similares, excepto que DNxHD también ofrece una versión de 8 bits para los códecs de gama baja. Dado que nuestro metraje es de 8 bits para empezar, eso no nos perjudicará en absoluto.

El flujo de trabajo proxy ha sonado bastante bien. ¿Por qué hacer el Intermedio Directo?

Parte de la razón por la que el flujo de trabajo del Intermedio Directo es común es porque solía ser mucho más difícil utilizar un flujo de trabajo proxy. Algunos de los principales proveedores de software no hacían que fuera especialmente fácil volver a enlazar con los archivos originales de la cámara, por lo que la gente elegía un flujo de trabajo intermedio directo. Hoy en día, sin embargo, es bastante fácil hacerlo en cualquier paquete de edición. La principal excepción es cuando tienes muchos tipos de metraje mezclados. Si tienes varias velocidades y tamaños de fotogramas en el mismo proyecto, el cambio de los proxies a los códecs de captura puede ser un dolor de cabeza.

Si estás utilizando algunas herramientas de terceros para ayudar a preparar y organizar tu material antes de empezar a cortar, también pueden hacer que el proceso de revinculación sea más complicado. Un ejemplo común podría ser el software que sincroniza automáticamente las pistas de audio o los rodajes multicámara.

Sin necesidad de intercambiar

Otra razón por la que podrías querer utilizar un flujo de trabajo de Direct Intermediate es porque puedes pasar directamente a la corrección de color y al proceso de VFX («acabado») sin intercambiar ningún archivo. Siga leyendo, y le explicaré más sobre por qué es conveniente en las secciones de Corrección de Color y VFX.

Una desventaja, sin embargo, es que no puede «hornear» las LUTs para su editor – va a tener que aplicar una LUT a través de un efecto de corrección de color en su software de edición. Si incluyera la LUT en su flujo de trabajo de transcodificación para Direct Intermediate, estaría perdiendo todas las ventajas de grabar en log en primer lugar.

El otro inconveniente obvio es que necesita almacenar todos estos archivos (mucho más grandes).

Un códec intermedio nunca hará que tus imágenes sean mejores

(volver al índice)

Esto es muy importante, porque es muy comúnmente mal entendido, y hay mucha información errónea en línea. Transcodificar tu material antes de editarlo nunca aumentará la calidad del resultado. Hay algunas operaciones extra que podrías hacer en el proceso de transcodificación (como usar sofisticadas herramientas de up-res) que podrían aumentar la calidad de la imagen en algunos casos, pero un nuevo códec por sí mismo nunca aumentará la calidad de tu imagen.

Si eliges el códec correcto, puedes evitar dañar tu imagen, pero nunca podrás mejorarla.

Eso incluye pasar de h.264 a DNxHD o ProRes. También incluye pasar de 8 bits a 10 bits. Y pasar de 4:2:0 a 4:4:4.

Aquí tienes una ilustración que puede ayudarte a entender este concepto:

Esta es una foto de una rosa reflejada en una gota de agua. Tiene 4 megapíxeles y se ve muy bien en mi monitor de 27 pulgadas.

Ahora qué pasa si tomo una foto de mi monitor con una cámara Red Helium 8k. Esta es una bestia de cámara. La foto de la rosa la hice hace unos años con una Canon Rebel DSLR barata, que hoy vale unos 250 dólares. La configuración de la Red Helium cuesta unos 50.000 dólares, tiene 35 megapíxeles, es raw, tiene uno de los mejores sensores de cámara jamás producidos.

¿Cuál será una mejor imagen – la foto de 4 megapíxeles, o la foto de 35 megapíxeles?

Una captura de una captura

La cámara Red tiene más megapíxeles, ¿verdad? Es raw y tiene toda la magia digital de Red, ¿no? Pero como estoy usando mi cámara de alta resolución para hacer una foto de la foto, no una foto de la rosa, mi nueva y elegante imagen nunca será mejor que la primera. Tengo un archivo que es técnicamente de mayor resolución, pero no captura más de mi tema (la rosa) que la primera.

Esto es lo que estás haciendo cuando estás transcodificando. Estás haciendo una copia de una copia, haciendo una foto de una foto. Si utilizas una cámara de alta resolución para tomar una foto de una foto, podrás preservar casi toda la información de la imagen original, pero no podrás añadir nada más.

La gran advertencia es que, si estás haciendo cualquier procesamiento, cualquier transformación de la imagen (añadiendo una LUT, por ejemplo), entonces definitivamente querrás transcodificar a un códec de mayor calidad, que retendrá nueva información. Pero si no estás alterando la imagen, entonces la transcodificación no hará que tu imagen sea de alguna manera «mejor».»

Un ejemplo del mundo real

(volver al índice)

Supongamos que estás editando un documental que capturó material 4K usando una cámara Sony A7sii, grabando en la versión long-GOP de XAVC-S. No es lo ideal para la edición. Si han grabado 40 horas de metraje para tu documental de larga duración, acabarías con unos 2,7TB de archivos de cámara, que pueden caber en un solo disco duro fácilmente (aunque hayas hecho otras copias de seguridad por separado, ¡claro!).

Podrías convertirlo a un códec de alta calidad y sin muchas pérdidas para un flujo de trabajo de Direct Intermediate, quizás ProRes 422 HQ en 4K.

El inconveniente es que necesitarías unos 12,7TB para almacenar todos esos archivos ProRes. Tendrías que utilizar una costosa configuración RAID para poder acceder fácilmente a todo ese material en un proyecto, al menos 1000 dólares. Una cantidad insignificante para una gran instalación, pero una inversión significativa para un editor en solitario.

Elegir proxy

Así que podrías decidir utilizar un flujo de trabajo Proxy en su lugar y transcodificar tus archivos al formato ProRes 422 Proxy 4K. Entonces tu material sólo ocuparía 2,8TB, apenas más que tu material capturado. Así podrás editar fácilmente desde un solo disco duro, y tu flujo de trabajo será mucho más sencillo. (Para obtener instrucciones sobre cómo calcular las tasas de bits y el tamaño de los archivos, consulta este artículo: La fórmula simple para calcular las tasas de bits de vídeo).

Digamos que estás trabajando con otro editor que está en el otro lado del país. Puede que decidas transcodificar el material aún más a ProRes 422 Proxy HD, lo que reduciría tu material a sólo 640 GB, lo que resulta más factible de enviar por Internet si tienes una conexión rápida. (18 horas de descarga con una conexión de 80Mbps)

Cuando la edición esté terminada, sólo tienes que volver a enlazar tu proyecto con los archivos originales de la cámara y exportarlos. Aunque tú y tu editor remoto hayáis trabajado con un códec con bastantes pérdidas, la exportación final lo evita, así que no pierdes nada de calidad.

El códec que corrige el color

(volver al índice)

Ok, ahora tienes tu vídeo editado, y es el momento de la corrección de color. Todo lo que estamos hablando aquí se aplica tanto si estás corrigiendo el color dentro de tu aplicación de edición, como si estás enviando tu edición a un software de corrección de color dedicado.

La gran pregunta en este punto es si quieres corregir el color directamente en los archivos originales de la cámara, o si quieres transcodificar. Si usted hizo una edición proxy/offline, entonces definitivamente no quiere corregir el color de los archivos proxy, porque tienen una calidad de imagen inferior. Para tomar buenas decisiones sobre el color, necesita la imagen de mayor calidad que tenga disponible, porque necesita ser capaz de ver exactamente con lo que tiene que trabajar.

Así que tenemos que trabajar con imágenes de alta calidad, y tenemos algunas opciones diferentes:

A. Calificar los archivos de la cámara

Esta es sin duda una opción sencilla. Si usted hizo una edición proxy, puede volver a vincular a los archivos de la cámara para el proceso de acabado y ir a la ciudad. Esto le dará la máxima calidad de imagen, pero ¿recuerda que los archivos de la cámara pueden ser lentos para trabajar? Los archivos de la cámara pueden ralentizar un poco el proceso, pero dependiendo del software que utilices y de la cantidad de trabajo que necesites hacer, puede que decidas que la simplicidad merece un poco de ralentización potencial. Si tiene una edición corta sin mucha complejidad, entonces este puede ser un flujo de trabajo excelente y fácil.

Supongamos que la ralentización de la corrección de color le molesta, por lo que necesita un códec que sea más fácil de trabajar. Podrías transcodificar todo tu material a un códec de alta calidad de imagen, enlazar a esos archivos y luego empezar a hacer tu corrección de color. Pero… eso anula el propósito de un flujo de trabajo proxy, ¿no es así? Usamos proxies porque no queríamos tener que lidiar con los grandes archivos que se crearían. Afortunadamente, hay otra opción.

B. Consolidar y transcodificar

(volver al índice)

Si utilizó un flujo de trabajo proxy/offline para la edición pero no quiere corregir el color de los archivos de la cámara, una buena opción es volver a enlazar con los archivos de la cámara, consolidar su proyecto y luego transcodificar a un códec de alta gama.

Cuando consolidas un proyecto, tu software de edición hará una copia de tu proyecto junto con una copia de los medios, pero sólo los archivos particulares que terminaste usando en tu secuencia. Por lo tanto, si has hecho 7 tomas pero sólo has utilizado una de ellas en la edición, sólo se copiará esa toma. Esto reduce mucho el almacenamiento, lo que resulta muy útil en esta fase. También puedes consolidar aún más, de modo que sólo conserves las partes específicas de cada toma que realmente utilizaste en la edición, descartando el resto. En este caso, el software suele incluir unos segundos antes y después de cada toma (llamados «handles»), por si quieres añadir un fundido o un seguimiento de movimiento.

Comienza tu corrección

Ahora puedes tomar este nuevo proyecto consolidado (después de volver a enlazar con los originales) y transcodificar todos estos archivos a un códec de alta calidad y alta tasa de bits, y empezar a corregir el color. Esto es diferente del flujo de trabajo del Intermedio Directo, porque no estás transcodificando todo el material, sino sólo el material que entró en la edición final, que puede ser 1/20 o 1/50 de la longitud del material que se rodó originalmente. Ahora no parece tan malo transcodificar a un códec de alta tasa de bits porque no tienes que almacenar tanto. Incluso con ProRes 4444 4K, un largometraje sólo ocupará unos 2 TB, algo bastante manejable.

Ahora puedes terminar tu película con imágenes de máxima calidad y un procesamiento rápido, en un disco duro que cabe en tu bolsillo.

C. Seguir con el Intermedio Directo

La tercera opción es seguir con el flujo de trabajo de edición del Intermedio Directo, en cuyo caso estás listo. Ya has transcodificado todos tus archivos a un códec de alta calidad antes de empezar a editar, así que puedes seguir con esos mismos archivos para la corrección de color. Eso también es conveniente porque esos archivos son buenos tanto para la edición como para la corrección de color y los efectos visuales (ver más abajo).

Si estás entregando el proyecto a un colorista externo o a una persona de efectos visuales, entonces puedes darle todo tu material de alta calidad (potencialmente molesto debido al tamaño), o puedes usar el mismo consejo de consolidación que usamos arriba. Entregar el proyecto consolidado puede ayudarte a avanzar más rápido y ahorrarle tiempo a tu colorista también.

Otra ventaja

Además de la simplicidad del flujo de trabajo de Direct Intermediate (usas sólo un conjunto de archivos), tienes otra ventaja: ir y venir entre la edición y la corrección de color es más sencillo.

Imagina que has terminado tu edición proxy – consolidas y transcodificas, lo envías a tu colorista, y luego decides que necesitas hacer algunos cambios en la edición. Ahora tienes que volver a los proxies para hacer la edición y luego volver a consolidar y enviar el material. La mecánica de esto puede ser bastante complicada. En un flujo de trabajo de postproducción de alto nivel, suele haber un «bloqueo» de la edición para que puedan comenzar los procesos de acabado. Esto significa que (a menos que ocurran cosas malas) te esforzarás por no volver atrás y hacer cambios en la edición. Pero bueno, las cosas malas ocurren, así que es mejor estar preparado.

Y ahora encontramos otra buena razón para una edición intermedia directa. Si vas a hacer parte de tu trabajo de color y tu trabajo de edición simultáneamente, o al menos vas a ir y venir un par de veces, entonces puede ser más simple usar un códec para ambos. Esto es especialmente conveniente si usted está haciendo su edición y acabado en el mismo paquete de software (o conjunto de paquetes, por ejemplo, Creative Cloud).

El códec que envía a VFX

(volver al índice)

Si usted está haciendo cualquier trabajo de VFX, entonces usted probablemente va a necesitar para enviar archivos a otro programa (potencialmente otra máquina, para otro artista). Si usted está haciendo todo su trabajo VFX en su editor (que es cada vez más viable para los trabajos simples), entonces usted puede saltar esta sección. Sólo tiene que utilizar el mismo códec que utilizó para su corrección de color.

Para la mayoría de nosotros, sin embargo, tenemos que establecer un proceso de «ida y vuelta» que envíe los clips desde el editor al software de VFX y luego de vuelta cuando estén terminados. Esto ocurre plano a plano, por lo que no se envía toda la secuencia a VFX, como probablemente se hizo para el etalonaje. La cuestión de cuándo enviar las tomas a VFX en el proceso depende en gran medida del flujo de trabajo particular.

Algunas personas enviarán a VFX después de que la edición esté bloqueada y la corrección de color terminada, pero la presión del tiempo puede obligar a empezar a enviar las tomas antes de ese momento.

Si está editando en Premiere Pro y haciendo VFX leves en After Effects con Dynamic Link, entonces también puede saltarse esta sección. Dynamic Link hace automáticamente el viaje de ida y vuelta para usted. Si estás haciendo mucho trabajo de VFX, puede que quieras usar las técnicas de esta sección, porque Dynamic Link puede ser un poco quisquilloso con demasiados proyectos. Sin embargo, Adobe siempre está trabajando en esos errores, por lo que en parte depende del gusto personal.

Vaya a lo grande o váyase a casa

En el proceso de VFX, se tiende a utilizar códecs de muy alta gama (alta tasa de bits) por dos razones principales. La primera es simplemente que los artistas de VFX necesitan toda la información que se les pueda dar para hacer bien su trabajo. Los artistas de efectos visuales son unos de los más exigentes en lo que respecta a los códecs, y con razón. Todo el mundo quiere imágenes de alta calidad, pero los problemas de imagen a menudo pueden plantear más problemas para los VFX que para la edición, la corrección de color y la exportación final.

Muchas tareas en el trabajo de VFX requieren un análisis muy detallado de la imagen a nivel de píxel por píxel, que la mayoría de los editores nunca necesitan hacer. Por ejemplo, si estás haciendo una extracción de pantalla verde, quieres que el borde entre tu personaje y la pantalla verde sea lo más limpio posible. Todos hemos visto tomas horribles de pantalla verde en las que los bordes del personaje aparecen entrecortados o borrosos. Estos problemas suelen surgir debido a artefactos de compresión de la imagen que son invisibles a simple vista. El submuestreo de color 4:2:2 o 4:2:0, por ejemplo, no tiene casi ningún impacto visible en la imagen. El ojo humano se preocupa principalmente por el contraste y rara vez nota una baja resolución de color, pero el proceso de extracción de la pantalla verde se basa principalmente en los valores de color. Si el códec ha desechado una gran parte de los valores de color al utilizar el submuestreo de croma 4:2:0, puede resultar imposible obtener una buena clave de color.

Pérdida de generación

La segunda razón por la que conviene utilizar códecs de gama alta es por la pérdida de generación. En el proceso de VFX, probablemente tendrá que comprimir su archivo varias veces. Comprimirás el archivo una vez cuando lo envíes a ellos. Y luego, si tienen que pasar el archivo entre varios especialistas, es posible que lo compriman dos o tres veces antes de devolverlo. Cuando un archivo se comprime varias veces, lo llamamos pérdida de generación múltiple.

Si se utiliza un códec de gama baja, la imagen empeorará progresivamente cada vez que se vuelva a comprimir. Una de las cosas buenas de los códecs de alta calidad es que puedes comprimirlos un par de veces sin perder mucha calidad. Aunque siempre es mejor evitar comprimir un vídeo varias veces, si utilizas códecs de muy alta calidad, normalmente no tendrás problemas.

Algunos flujos de trabajo de VFX de gama alta sólo utilizan compresión sin pérdidas por esta razón. La buena noticia es que las tomas de VFX suelen durar sólo unos segundos por clip, lo que significa que el tamaño de los archivos será pequeño incluso con códecs de alta calidad. Así que ¡hazlo a lo grande! Si capturaste 4:4:4 en la cámara, entonces definitivamente envía 4:4:4 a VFX. De lo contrario, yo elegiría un códec 4:2:2 de gama alta (ProRes 422 HQ o DNxHQX).

Y, por supuesto, siempre debes comunicarte de antemano con los VFX sobre qué códec enviar. Si crees que están haciendo una mala elección, envíales este artículo 🙂

El códec que exportas

(volver al índice)

Ahora que has terminado la edición, el color y los VFX, estás listo para exportar. Por lo general, usted hará la exportación final desde el software que utilizó para la corrección de color, utilizando el códec que utilizó en el proceso de corrección de color.

Si su cliente está en el negocio de los medios de comunicación, debe saber qué códec quiere, por lo que puede saltarse el resto de esta sección.

Si su cliente no es un experto en vídeo, puede que no sepa lo que quiere, por lo que debe tomar algunas decisiones por él. La mayoría de las veces, su cliente va a querer un video para subir a YouTube y / o otros sitios de medios sociales. Es posible que tengas la tentación de elegir un códec que sea bueno para el streaming en Internet. La razón es que estos sitios no transmiten el mismo archivo que usted sube a sus espectadores: comprimen el archivo *de nuevo* antes de transmitirlo, y usted no tiene ningún control sobre la configuración que utilizan. Esto significa que, si subes un códec de baja calidad, entonces tenemos el escenario en el que estamos tomando una foto de baja calidad de una foto de baja calidad de la que hablamos. ¡Mal! Evita¡

Apunta a la mejor calidad

Como regla general, si quieres el resultado de mejor calidad, debes subir la fuente de mejor calidad. Ellos van a comprimir de nuevo de todos modos, por lo que darles más datos de trabajo no puede hacer daño, ¿verdad? Si tienes una conexión lo suficientemente rápida, podrías subir un ProRes 422. Algunas personas han reportado ligeramente (sólo ligeramente) mejores resultados al subir ProRes en lugar del recomendado h.264.

Si estás entregando un archivo a un cliente, para que lo suba a Youtube, entonces yo no les daría ProRes, ya que no sabes qué tipo de ancho de banda van a tener. Afortunadamente, estos sitios suelen publicar las especificaciones de subida recomendadas (basta con buscar en Google). Yo, personalmente, tomo el bitrate que recomiendan y lo multiplico por 1,5x o 2x.

También es posible que tu cliente quiera un archivo que pueda incrustar directamente en su página web (aunque yo les disuadiría, si puedes). En general, usted quiere un h.264 muy comprimido. Si tienes curiosidad por saber cuál es una buena tasa de bits, mi razonamiento es que, si alguien sabe cuál es la tasa de bits óptima, es YouTube. Periódicamente descargo un vídeo de YouTube y compruebo su bitrate, y lo utilizo como punto de referencia.

Ser pequeño

Si el vídeo no es público, también pueden querer un archivo pequeño que puedan enviar por correo electrónico o enlazar directamente a sus propios clientes para que puedan descargarlo. En estos casos, puede ser conveniente entregar más de dos archivos separados, sobre todo si se trata de un vídeo largo. El archivo que deben subir a YouTube será demasiado grande para enviarlo por correo electrónico convenientemente. En este caso, suelo bajar la resolución del archivo y comprimirlo mucho. También tienes que ser realista y decidir si crees que tu cliente entenderá realmente la diferencia entre los dos archivos.

Si tengo que entregar más de un archivo, suelo llamar a uno de ellos «HD» en el nombre del archivo y al otro «pequeño» o «no HD» en el nombre del archivo. Si intentas describirles los diferentes códecs, casi puedo garantizar que habrán olvidado la diferencia para la próxima semana, pero probablemente recordarán lo que significa HD y «no HD».

El códec que archivas

(volver al índice)

Has entregado los archivos a tu cliente, así que ahora puedes sentarte y relajarte… casi.

Como sabe cualquier profesional de esta industria, el día en que entregas el producto terminado a tu cliente no suele ser la última vez que tocas un proyecto. A veces un cliente quiere volver y cambiar algo semanas después, o quiere un códec de mayor calidad, o tal vez quieres añadirlo a tu carrete personal. En cualquiera de estos casos, puede que hayas cambiado de máquina o de software, lo que hace que sea un dolor de cabeza abrir el proyecto original y volver a exportarlo.

Eso es práctico

Aquí es donde viene bien tener un gran archivo del proyecto terminado en un códec de altísima calidad. Si su cliente pidió un códec de muy alta calidad para la entrega, entonces usted está generalmente listo. Guarda una copia de ese archivo y ya está. Sin embargo, si necesitan un códec de entrega que no sea de máxima calidad, siempre es bueno hacer tu propia exportación con un códec sin pérdidas o lo más cercano a ellas que puedas permitirte, dado el espacio que ocupará. Por lo general, exportaré a un códec 4:4:4 de muy alta tasa de bits, ya sea DNxHD/HR o ProRes.

¿Tienes preguntas? Comenta.

Realmente leo todos los comentarios. Este artículo es un trabajo en progreso, y voy a actualizar con más explicaciones y ejemplos sobre la base de sus comentarios. Si tienes algún comentario privado o preguntas, envíame un correo electrónico: david at frame dot io.

¿Quieres escribir para el blog de Frame.io? Envíame un correo electrónico a: blog at frame dot io.

¡Muchas gracias a Larry Jordan, Shane Ross y Philip Hodgetts por sus aportaciones a este artículo!