Les codecs n’ont pas besoin d’être difficiles. Non, vraiment, ils ne le sont pas. Tout ce qui compte, c’est que vous choisissiez le bon codec.

À la fin de cet article, vous serez capable de choisir le meilleur codec pour vous sur chaque projet. Mon objectif est de vous donner ce dont vous avez besoin pour prendre vos propres décisions éclairées sur les codecs. Ainsi, vous pourrez choisir le bon codec pour vous-même, au lieu de vous fier à ce qui a fonctionné pour quelqu’un d’autre.

Je vais vous accompagner à chaque étape du processus de réalisation d’une vidéo. Cliquez sur un titre pour passer à cette section. Je vais couvrir :

- Le codec que vous filmez

- Le codec que vous montez

- Le codec que vous corrigez en couleur

- Le codec que vous envoyez aux VFX

- Le codec que vous exportez

- Le codec que vous archivez

À chaque étape, je vous expliquerai les facteurs à prendre en compte pour choisir un codec. Je vous donnerai également quelques exemples des codecs les plus couramment utilisés pour cette étape.

En cours de route, nous couvrirons les raisons pour lesquelles les codecs bas de gamme et les codecs haut de gamme peuvent chacun ralentir votre montage, les raisons d’un montage proxy/offline, une promenade dans un projet réel, quelques stratégies d’économie de stockage et une explication de la raison pour laquelle le transcodage ne peut pas améliorer la qualité de votre image.

Les avantages de l’optimisation de vos codecs peuvent être énormes. Choisissez le bon codec et vous préserverez vos images dans la meilleure qualité possible. Il peut également rendre votre travail plus rapide et vous permet de tirer le meilleur parti de votre ordinateur et de votre stockage. Vous serez en mesure de travailler plus rapidement sur un ordinateur portable que beaucoup sur une tour haut de gamme.

Ce que fait un codec

Un codec est une méthode pour rendre les fichiers vidéo plus petits, généralement en jetant soigneusement les données dont nous n’avons probablement pas vraiment besoin. Et ils sont assez intelligents sur la façon dont ils le font. Il y a quelques années, j’ai créé une vidéo qui couvre les principales techniques de compression utilisées par de nombreux codecs. Ce n’est pas un visionnage obligatoire pour comprendre cet article, mais cela ne fera certainement pas de mal.

Comment fonctionnent les codecs – Tutoriel.

Si vous sautez la vidéo, voici quelques explications très basiques :

- Sous-échantillonnage chroma : Jette certaines données de couleur (4:4:4 n’est pas un échantillonnage chroma. 4:2:2 est un peu de sous-échantillonnage chroma.4:2:0 est beaucoup de sous-échantillonnage chroma). C’est mauvais si vous faites de la correction de couleur. Vraiment mauvais si vous faites un écran vert ou un travail VFX.

- Macro-blocage : Trouve des blocs (de taille variable) de couleurs similaires et les rend tous de la même couleur. Mauvais pour les effets visuels et la correction des couleurs. Presque tous les codecs l’utilisent à un certain degré, et la quantité a tendance à varier avec le débit binaire.

- Compression temporelle : Utilise les images précédentes (et parfois les images suivantes) pour calculer l’image actuelle. Mauvais pour l’édition.

- Profondeur de bit : Le nombre de couleurs possibles. Une profondeur de bit plus profonde (nombres plus grands) est bonne pour la correction des couleurs et les VFX.

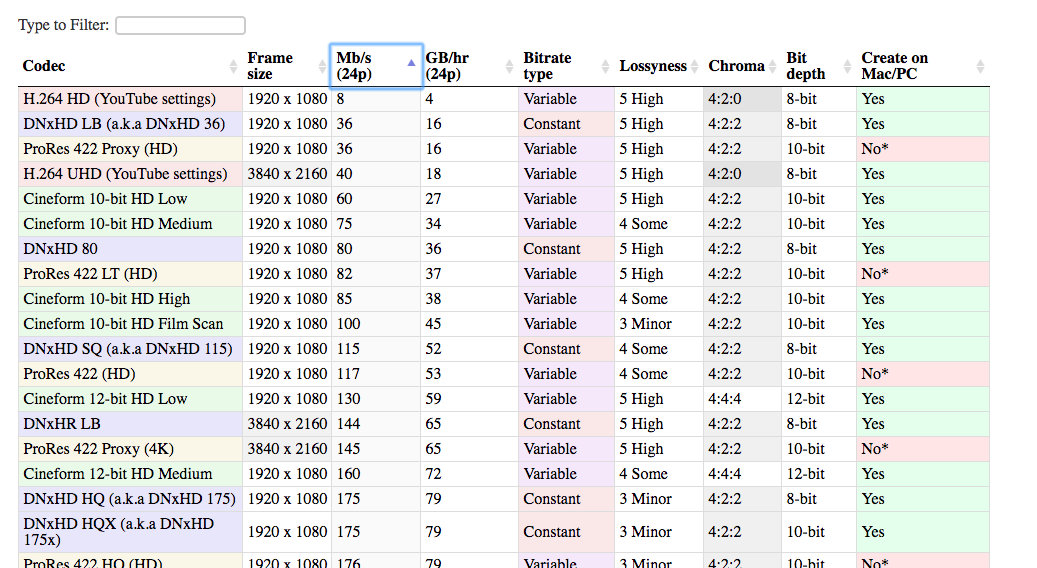

Tableau de comparaison des codecs

J’ai également rassemblé une liste de tous les codecs les plus courants utilisés dans le monde de la postproduction. Cette liste peut vous aider à comparer différents codecs entre eux et à prendre la meilleure décision pour votre projet.

Il existe de nombreux codecs différents qui peuvent être utilisés dans le processus de montage. Ceux que j’ai inclus sont de loin les plus courants. Il y a un avantage significatif à utiliser les codecs populaires. Ils ont plus de chances de fonctionner sur votre système, celui de votre client, votre système dans cinq ans, etc. Et il est plus facile de trouver de l’aide si quelque chose ne va pas.

Ouvrir le tableau dans un nouvel onglet. De cette façon, vous pouvez comparer les codecs au fur et à mesure que vous lisez l’article.

Voir le tableau

Lossyness

L’une des colonnes du tableau est « lossyness », qui est un concept important avec les codecs. Quand je parle de perte, je ne parle pas nécessairement de ce que votre œil voit. Je parle de la quantité de données qui est retenue par le codec, dont vous ne voyez qu’une partie. La question est la suivante : si j’ai une image non compressée, puis que je la compresse avec ce codec, quelle sera la ressemblance entre la nouvelle image et l’ancienne ? Combien d’informations sont perdues lors du transcodage ? Si les deux images sont très similaires, alors le codec n’est pas très sensible aux pertes. Et si elles sont assez différentes, alors il est plus lossy.

La lossyness est une combinaison des techniques que le codec particulier utilise et de son débit binaire. Un codec plus lossy n’est pas nécessairement mauvais. Dans certains cas (lors de la visualisation en ligne, par exemple), il n’est vraiment pas nécessaire de conserver 100 % de l’image originale. L’utilisation d’un codec plus déficitaire peut être une décision vraiment intelligente en raison de l’espace qu’elle permet d’économiser.

Si l’image semble aussi bonne à mon œil, alors pourquoi devrais-je me soucier du fait qu’elle soit techniquement » déficitaire » ?

Vous devriez vous en soucier parce que vous pourriez vouloir modifier l’image. Si vous effectuez une quelconque correction des couleurs, alors vous allez modifier l’image. Le résultat pourrait être que vous voyez des éléments de l’image qui n’étaient pas visibles (ou proéminents) lorsque vous l’avez capturée.

Par exemple voici une image qui a été capturée brute.

Voici un screengrab de celle-ci compressée avec H.264, en utilisant un paramétrage standard recommandé par YouTube.

Et ensuite compressé avec DNxHD 350x:

Ils ont tous l’air à peu près pareils, n’est-ce pas ? La qualité visuelle est à peu près la même, et le fichier H.264 ne représente qu’une fraction de la taille du fichier DNxHD. C’est pourquoi c’est le paramètre recommandé pour YouTube. Il est à peu près aussi beau à l’œil, et le fichier est beaucoup plus facile à télécharger sur Internet.

Le problème avec la version H.264, cependant, survient lorsque vous essayez d’apporter des modifications à l’image. Et si vous vouliez augmenter l’exposition ?

Maintenant, nous pouvons voir où l’image hautement compressée s’effondre. Ses cheveux et sa chemise ont un aspect terrible dans l’image h.264, et les bâtiments près de la rivière ont l’air tout mous.

C’est pourquoi vous voulez vraiment un codec de haute qualité lorsque vous capturez l’image. Parce que vous voudrez probablement faire des changements plus tard, mais vous ne savez pas encore quels pourraient être ces changements. Vous voudrez modifier la couleur et le contraste, peut-être modifier la vitesse, peut-être ajouter des effets visuels. Un fichier hautement compressé ne permet pas ces changements sans se décomposer.

C’est pourquoi c’est une bonne idée de capturer votre métrage en 10 bits même si vous pouvez sortir un fichier 8 bits à la fin. Vous ne savez pas, lorsque vous filmez, quels bits vous allez vouloir.

Le voyage du codec

Maintenant, il est temps de parcourir les différentes étapes que vous rencontrerez dans chaque projet.

Chaque projet commence avec un codec que vous capturez dans la caméra. Et se termine par un codec que vous exportez (codec de livraison) et que vous remettez à votre client ou que vous téléchargez sur le web. Dans le cas le plus simple, vous effectuez toutes vos opérations de montage et de correction des couleurs directement sur les fichiers de la caméra. Puis vous exportez vers votre codec de livraison, donc vous n’utilisez jamais que deux codecs.

Mais la plupart du temps, cela devient un peu plus compliqué. Vous pourriez transcoder vers un codec différent pour le montage, et potentiellement pour la correction des couleurs, et certainement pour les VFX. Mais tout commence par…

Le codec avec lequel vous filmez

(retour à l’index)

C’est votre codec de capture, (également appelé « codec natif de la caméra » ou « codec d’acquisition »).

En règle générale, vous devez viser le codec de la plus haute qualité que votre caméra (ou votre budget) peut capturer. Quand je dis « la plus haute qualité », je veux dire que vous voulez capturer autant d’informations que possible. Il faut donc opter pour des codecs à faible perte : moins de compression, une plus grande profondeur de bits et moins de sous-échantillonnage chromatique. Plus vous avez d’informations au moment de la capture, plus vous aurez de flexibilité par la suite. Surtout pour la correction des couleurs et les effets visuels (si vous en faites).

Bien sûr, vous devez aussi prendre en compte beaucoup d’autres facteurs pratiques dans cette décision. Sinon, nous serions toujours en train de tourner en 8K brut, non ?

Coût

La première considération est évidemment le coût. En général, plus la caméra est chère, plus les codecs de qualité sont disponibles sur elle. Je dis généralement car il y a quelques caméras « sweet spot » qui peuvent offrir d’excellents codecs à un prix raisonnable. La série GH de Panasonic (surtout au début, lorsque la GH2 a été piratée) était connue pour offrir de meilleurs codecs que les autres caméras de sa gamme de prix.

Introduction : de meilleurs codecs avec des enregistreurs externes

Une façon de capturer des codecs de meilleure qualité sur des caméras moins chères est d’utiliser un enregistreur externe.

Ces appareils (dont beaucoup peuvent se doubler de moniteurs externes) prennent un signal non compressé de la caméra, via HDMI ou SDI, et le compressent séparément. Vous vous retrouvez donc avec deux copies de votre métrage. Une copie fortement compressée sur la caméra, et une seconde copie légèrement compressée sur l’enregistreur externe. L’élément clé ici est que la caméra envoie le signal à l’enregistreur avant de le compresser.

Une note importante ici est que de nombreuses caméras moins chères ne sortent que 8 bits, et souvent pas en 4:4:4. Un enregistreur externe pourrait être capable de compresser vers un codec 12 bits. Mais si la caméra n’envoie que 8 bits, l’enregistreur ne peut enregistrer que 8 bits. Certaines caméras moins chères peuvent également ne pas émettre un signal HDMI « propre » adapté à l’enregistrement. Nous appelons un signal de sortie « propre » lorsqu’il s’agit juste de l’image pure, sans superposition d’interface de caméra.

Stockage

Le deuxième facteur à prendre en compte est l’espace de stockage. Les codecs de haute qualité ont tendance à avoir un débit binaire plus élevé, ce qui signifie que les fichiers sont plus volumineux. Vous devez être prêt à stocker et à sauvegarder tous ces fichiers pendant que vous filmez. Vous devrez peut-être aussi mettre à niveau vos cartes mémoire afin de pouvoir enregistrer les données à haut débit. Si vous tournez en solo, alors vous pouvez finir par choisir un codec de qualité inférieure parce qu’il vous permet de changer de carte mémoire moins souvent.

Finition

Un autre facteur à prendre en compte est la quantité de correction des couleurs et de VFX (collectivement appelés finition) que vous prévoyez de faire. Si vous allez faire une correction des couleurs très minime et aucun VFX, alors vous pouvez probablement vous en sortir avec une profondeur de bit plus faible, un sous-échantillonnage chromatique et un blocage macro qui viennent avec des codecs de capture de qualité inférieure.

Matériel de montage

Le dernier facteur à considérer est votre machine de montage. La plupart des codecs de capture ne sont pas bien adaptés au montage sans un ordinateur performant. Le H.264 et certains fichiers bruts nécessitent un CPU/GPU puissant pour un montage fluide. Et les codecs à très haut débit peuvent nécessiter des disques durs ou des serveurs de données à grande vitesse. À moins que vous n’utilisiez un codec adapté au montage, vous devrez peut-être transcoder vos fichiers vers un autre codec avant le montage. Et cela peut prendre du temps. Pour certains, le transcodage du métrage n’est pas un problème majeur car il peut être effectué pendant la nuit ou sur un ordinateur de rechange. En revanche, si vous travaillez dans des délais très courts, vous pouvez choisir un codec qui vous permettra de commencer le montage immédiatement après le tournage, même si cela implique un coût plus élevé ou un sacrifice de la qualité de l’image. J’explique quels sont les meilleurs codecs pour le montage dans la section suivante.

Le codec avec lequel vous montez

(retour à l’index)

D’accord, vous avez tourné votre film, et vous avez mis tous vos fichiers sur votre ordinateur. Maintenant vous devez décider si vous allez monter avec ces fichiers. Ou si vous voulez transcoder dans un autre format.

Pourquoi devrais-je transcoder avant le montage ? Ne puis-je pas simplement éditer les fichiers qui sont sortis de la caméra ?

Eh bien, cela dépend. Pratiquement tous les principaux logiciels peuvent maintenant éditer n’importe quel codec que votre caméra crée. (Sauf si vous êtes un badass qui tourne sur une toute nouvelle caméra avec une toute nouvelle technologie). Mais s’il est presque toujours possible d’éditer les codecs que votre caméra a filmés, ce n’est pas toujours la meilleure idée.

Si vous avez la chance de filmer sur un codec qui est excellent pour l’édition, vous pouvez sauter cette étape.

Pour beaucoup d’entre nous, cependant, le codec de capture ne va pas être optimisé pour l’édition. Il y a deux facteurs principaux que vous devez prendre en compte lorsque vous choisissez votre codec d’édition : le type de compression et le débit binaire.

Les codecs fortement compressés peuvent ralentir votre édition

(retour à l’index)

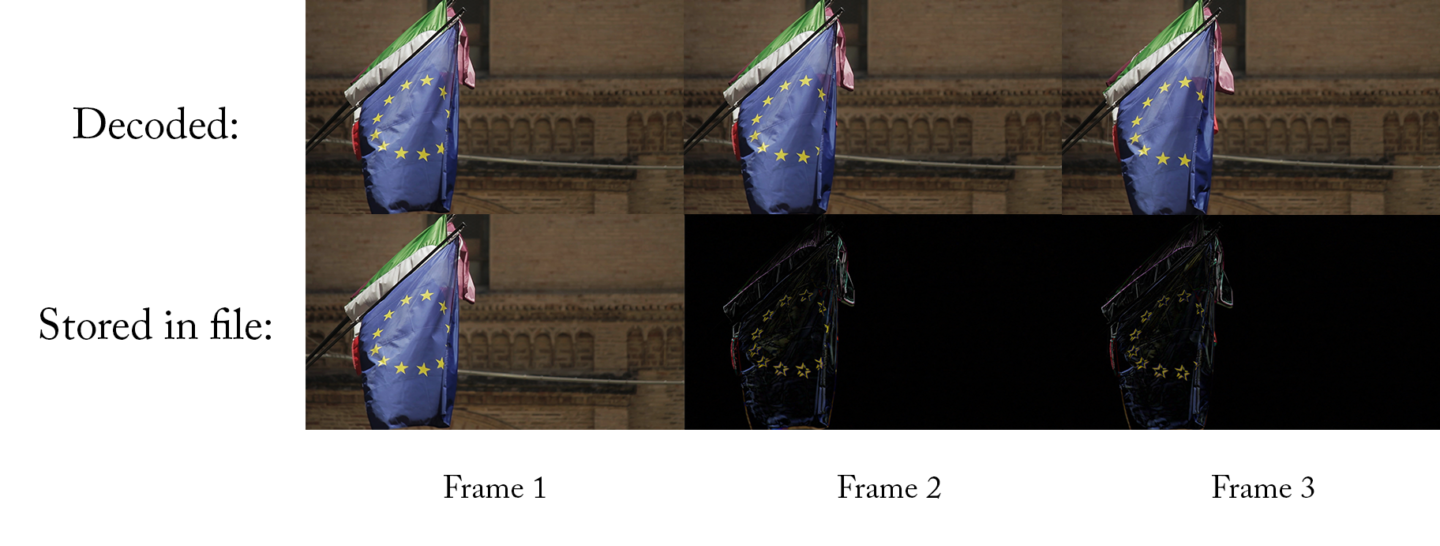

La plupart des caméras de bas à moyen de gamme enregistrent avec des codecs qui utilisent la compression temporelle, également connue sous le nom de compression long-GOP. Je vais vous donner une explication simple ici, mais si vous êtes intéressé à apprendre plus en détail, consultez ma vidéo sur les codecs, à partir de 19:00.

L’explication simple d’un long-GOP est que, pour chaque image, le codec ne capture que ce qui a changé entre cette image et l’image précédente. Si la vidéo ne comprend pas beaucoup de mouvement, alors le nouveau fichier peut être BEAUCOUP plus petit. La différence entre cette image et la dernière image n’est que de quelques pixels. Donc, tout ce que vous devez stocker, ce sont quelques pixels. C’est génial!

Toujours en avant

Le problème, cependant, est que ces codecs ont tendance à ne bien fonctionner que lorsqu’ils sont lus en avant. (Si vous êtes curieux de savoir pourquoi, jetez un coup d’œil à la vidéo). C’est parfait pour le visionnage sur YouTube et votre lecteur DVD, mais ce n’est pas génial pour le montage. Lors du montage, vous êtes souvent amené à faire des sauts ou à lire un clip en sens inverse. Et il faut beaucoup plus de puissance de traitement pour faire ces choses rapidement avec un codec à long GOP. Un ordinateur haut de gamme pourrait n’avoir aucun problème, mais même un ordinateur de milieu de gamme sera décalé et bégaiera lorsque vous parcourez rapidement le métrage ou que vous sautez dans tous les sens.

Les codecs qui ne sont pas à long GOP (alias codecs intra-image), peuvent lire en arrière aussi facilement qu’en avant. Ainsi, même un ordinateur de milieu de gamme peut faire des sauts très fluides. Si vous n’avez jamais édité que des clips directement depuis la caméra, vous ne réaliserez peut-être pas ce que vous manquez !

L’autre chose qui peut causer des problèmes avec la lecture est la vidéo brute. La vidéo brute doit être convertie avant de pouvoir être affichée (un peu comme le fait un codec). Et certains ordinateurs ne peuvent pas décoder le fichier brut assez rapidement, surtout s’il s’agit de 4K. Ironiquement, les caméras bas de gamme et les caméras les plus haut de gamme produisent des fichiers difficiles à monter !

Les codecs à haut débit peuvent ralentir votre montage

(retour à l’index)

Pour les codecs bas à moyen de gamme, vous n’avez pas du tout à vous soucier des débits. En revanche, une fois que vous commencez à monter en gamme, les codecs à haut débit peuvent poser des problèmes de montage, surtout si vous travaillez sur des ordinateurs courants.

La raison en est que votre ordinateur doit être capable de lire les données de votre disque dur à un débit au moins aussi élevé que celui de votre codec. C’est logique – si votre codec est de 50Mb/s (cinquante mégabits par seconde), alors votre ordinateur doit être capable de lire ce fichier sur votre disque dur à 50Mb/s, sinon il prendra du retard et bégaiera.

(notez que Mb/s signifie mégabits par seconde, tandis que MB/s signifie mégaoctets par seconde. Il y a huit bits dans un octet, il faut donc multiplier par 8 lors de la conversion de MB/s en Mb/s)

Quelques bonnes nouvelles

La bonne nouvelle est que les disques durs deviennent plus rapides chaque jour. Donc 50Mb/s ne va jamais poser de problèmes. Mais qu’en est-il si vous montez du ProRes 422HQ à 4K, ce qui représente 734Mb/s ? Le disque dur externe moyen est tout juste assez rapide pour lire ce format. Certains disques durs moins chers n’y parviendront pas du tout. Et puis, que se passe-t-il si vous montez un multicam avec trois caméras ? Soudain, vous avez besoin d’un débit de données trois fois supérieur : 2 202 Mb/s ! À ce moment-là, vous allez devoir investir dans des disques durs haute performance ou des RAID.

Voici quelques lignes directrices approximatives pour les vitesses de stockage de données courantes. (Il y aura toujours certains modèles qui seront moins performants ou plus performants.)

- Disque rotatif standard : 100-120MB/s

- Lecteur rotatif professionnel : 150-200 Mo/s

- Disque dur standard : 400-500 Mo/s

- RAID bas de gamme : 200-300 Mo/s

- RAID haut de gamme : 1000-2000 Mo/s

La prise de vue en log peut ralentir votre montage

La prise de vue en log est un moyen de préserver autant que possible votre plage dynamique. Cela permet d’obtenir une scène qui présente des hautes lumières et des ombres sombres sans souffler les hautes lumières ou écraser les noirs. Le soufflage des hautes lumières est un effet secondaire particulièrement désagréable de la prise de vue en vidéo plutôt qu’en pellicule. La prise de vue en mode logarithmique peut donc contribuer à donner à votre métrage un aspect plus cinématographique. Maintenant que les profils log sont disponibles même sur la plupart des caméras prosumer, c’est une façon de travailler extrêmement populaire.

L’inconvénient

L’inconvénient est que l’image qui sort de la caméra n’est pas si belle. Vous devrez ajouter du contraste et de la saturation afin de vous rapprocher de l’image finale. Le moyen le plus courant d’y parvenir est d’ajouter une LUT à votre métrage. Il s’agit essentiellement d’une simple correction de couleur prédéfinie qui ramène votre métrage à un aspect « normal ».

Si vous filmez dans un espace couleur logarithmique, alors vous devez appliquer une LUT à votre métrage afin de le prévisualiser avec une couleur et un contraste normaux. Cela signifie que votre éditeur devra appliquer la LUT appropriée à tous les clips lors du montage. Cela peut être fastidieux à gérer et peut également ralentir un peu l’ordinateur. En effet, il doit d’abord décoder chaque image, puis appliquer la LUT avant de l’afficher. Il est certainement possible de monter le métrage du journal sans aucune LUT, mais ce n’est pas idéal. La couleur de deux plans peut influencer la façon dont vous les entrecoupez.

Si vous allez transcoder vos fichiers avant de les éditer, alors vous pouvez appliquer la LUT pendant le processus de transcodage. De cette façon, le monteur travaille toujours avec un métrage qui a un bon contraste et une bonne couleur et n’a jamais à s’embêter avec les LUTs. Notez que vous ne devez faire cela que si vous utilisez un workflow Proxy, et non un workflow Direct Intermediate (décrit ci-dessous).

Penser au temps passé à encoder

Le principal inconvénient du transcodage de votre métrage avant le montage est tout simplement le temps nécessaire pour effectuer le transcodage. Si vous avez beaucoup de métrage à parcourir, et que votre ordinateur n’est pas rapide, cela peut prendre beaucoup de temps. Si vous n’êtes pas très pressé, vous pouvez laisser le transcodage fonctionner toute la nuit, potentiellement sur plusieurs ordinateurs si vous y avez accès, mais ce n’est pas toujours idéal.

Lorsque je travaillais à la Khan Academy, notre fondateur enregistrait régulièrement de courts messages vidéo à envoyer aux gens. Qui avaient souvent des horaires très serrés. Je filmais généralement en 4K dans un format log long-GOP, et je les montais sur un MacBook Pro. Le montage en 4K long-GOP avec une LUT (pour corriger le métrage log) sur un ordinateur portable signifiait que je pouvais lire la vidéo très bien dans Premiere Pro, mais je ne pouvais pas zoomer sur la ligne de temps aussi vite que je le voulais sans bégayer.

Mais cela ne me dérangeait pas trop parce que le montage était extrêmement simple. Juste quelques coupures, peut-être de la musique, un titre, et j’avais terminé. Même si ma vitesse de montage n’était pas idéale, j’aurais passé plus de temps dans le transcodage que je n’en aurais gagné en vitesse de montage, donc j’ai simplement utilisé les fichiers originaux.

Si je devais monter un morceau plus long avec la même configuration, cependant, je transcoderais en DNxHD ou ProRes. En général, je faisais la plupart du transcodage pendant la nuit, souvent avec plusieurs machines fonctionnant en même temps.

Montage proxy

(retour à l’index)

Si vous allez transcoder les fichiers natifs de la caméra avant de les monter, alors vous utiliserez un codec « intermédiaire ». Il est appelé intermédiaire car il se situe entre le codec de capture et le codec d’exportation. Il existe deux façons courantes de travailler avec les codecs intermédiaires :

La première est le workflow « proxy » ou « montage hors ligne ». Cela signifie que vous transcodez votre métrage capturé dans un format intermédiaire, que vous montez avec ce format, puis que vous rétablissez le lien avec les fichiers originaux de la caméra avant de les exporter. Étant donné que vous utiliserez les fichiers de la caméra pour exporter et non les fichiers proxy, vous n’avez pas besoin de vous soucier de choisir un codec proxy avec une grande qualité d’image – les codecs avec perte sont parfaits. Vous pouvez optimiser la vitesse d’édition et la commodité de stockage à la place.

Le workflow proxy est si commun que de nombreuses caméras haut de gamme enregistrent un fichier brut haut de gamme *et* un fichier proxy ProRes ou DNxHD en même temps. Après le tournage, les fichiers bruts sont sauvegardés et stockés. Les fichiers proxy sont envoyés aux monteurs et aux réalisateurs/producteurs pour les rushes.

Éviter la compression temporelle

Lorsque vous choisissez un codec proxy, vous voulez en choisir un qui n’utilise pas la compression temporelle (alias compression inter-image ou compression long-GOP), et vous voulez en choisir un qui a un débit binaire inférieur. Le faible débit binaire signifie que les fichiers sont beaucoup plus petits, de sorte que vous pouvez utiliser moins de disques durs / plus petits / moins chers, ce qui simplifie votre flux de travail. Woot!

Bien que les fichiers proxy soient excellents pour l’édition, vous ne devriez pas faire plus qu’une correction de couleur de base avec les fichiers proxy. Si vous allez faire toute votre correction de couleur à l’intérieur de votre logiciel d’édition, alors il est préférable de rétablir le lien avec vos fichiers de caméra parce que vos fichiers proxy peuvent avoir une qualité de couleur inférieure.

La bonne nouvelle est que la plupart des logiciels d’édition d’aujourd’hui peuvent basculer entre les fichiers de caméra et les fichiers proxy en quelques clics, de sorte que vous pouvez même aller et venir si vous avez besoin.

Nous avons publié des guides détaillés pour les flux de travail proxy dans chacun des principaux NLE :

- Final Cut Pro X Proxy Workflows

- Premiere Pro Proxy Workflows

- Avid Media Composer Proxy Workflows

Quelques bons choix pour les codecs proxy

De loin, les codecs proxy les plus courants sont DNxHD/DNxHR et ProRes. Ils existent tous deux depuis des années, ils sont donc très largement supportés. Tout le monde sait comment les gérer. Ils sont tous deux très bien adaptés à un workflow proxy (ProRes a même un préréglage appelé « proxy »), et sont presque interchangeables lorsqu’ils sont utilisés pour les proxies.

DNxHD est fabriqué par Avid, et ProRes est fabriqué par Apple. Il est donc logique que DNxHD fonctionne mieux sur Media Composer et que ProRes fonctionne mieux sur Final Cut Pro X. C’était certainement vrai auparavant, mais aujourd’hui les deux codecs fonctionnent très bien sur tous les éditeurs modernes (y compris Premiere Pro). Il peut y avoir une légère augmentation de la vitesse en utilisant le codec qui a été conçu pour le système, mais c’est très léger.

La seule différence significative entre les deux pour un flux de travail proxy est le fait que vous pouvez avoir du mal à créer ProRes sur un PC, tandis que DNxHD est très facile à créer multiplateforme. Le seul moyen officiellement pris en charge pour créer du ProRes sur un PC est Assimilate Scratch. Il existe d’autres méthodes non prises en charge pour créer des fichiers ProRes sur un PC, mais elles ne sont pas toujours fiables. Les PC peuvent facilement lire et éditer des fichiers ProRes, mais vous ne pouvez pas encoder de nouveaux fichiers ProRes sur un PC aussi facilement que le DNxHD, et certains monteurs préfèrent donc un workflow DNxHD pour cette raison.

Prenez une voie

Quoi que vous choisissiez parmi les deux codecs, vous devez également choisir quelle saveur vous voulez. Cela va vraiment dépendre de vos contraintes de stockage – c’est un compromis entre la qualité de l’image et la taille du fichier. La bonne nouvelle est que vous n’avez pas besoin d’une qualité d’image tip-top lorsque vous éditez, vous pouvez donc choisir un codec à faible débit.

Démarrez avec le plus petit codec ProRes ou DNx dans la même résolution que votre codec de capture. Regardez la colonne GB/hr et multipliez-la par le nombre d’heures de métrage que vous avez. Si vous disposez d’un espace de stockage suffisant, c’est bon – utilisez ce codec. Si vous avez beaucoup d’espace de stockage supplémentaire, pensez à utiliser la saveur la plus grande suivante.

Mais si vous n’avez pas assez d’espace de stockage, ou si vous êtes sur une machine sous-puissante, alors descendez d’un cran la résolution. Beaucoup de films hollywoodiens à gros budget ont été montés en 480p il y a seulement quelques années, alors ne vous inquiétez pas si vous devez baisser votre résolution de 4K à 720P pour le montage.

Intermédiaire direct

L’autre type de workflow intermédiaire est quelque chose que j’appelle intermédiaire direct. Cela signifie que vous transcoder vos fichiers de caméra dans un codec qui est à la fois bon pour le montage et de très haute qualité (pas très lossy). Comme le codec est de très haute qualité, presque toutes les informations originales des fichiers de la caméra ont été préservées, et il n’est donc pas nécessaire de rétablir le lien avec les fichiers de la caméra – vous pouvez simplement exporter directement à partir des fichiers intermédiaires. Il y aura une certaine perte théorique d’informations lors du transcodage, mais si vous choisissez un codec intermédiaire suffisamment bon, elle sera suffisamment faible pour que vous n’ayez pas à vous en soucier.

(Note : j’appelle ce processus « Direct Intermediate » parce qu’il n’y a pas de nom commun pour ce flux de travail. Les gens l’appellent généralement simplement « intermédiaire », mais cela peut prêter à confusion parce que les flux de travail proxy sont également une sorte de flux de travail intermédiaire. Certaines personnes appelleront également ce flux de travail « en ligne », mais cela prête également à confusion car ce terme a été créé pour décrire un flux de travail qui comprend un montage hors ligne et un montage en ligne, et non un flux de travail en ligne du début à la fin.)

La préservation est la clé

La clé pour choisir un bon codec Direct Intermediate est de s’assurer que vous préservez toutes les informations de votre codec de capture. Un codec intermédiaire ne rendra jamais vos images meilleures (explication plus détaillée ci-dessous), mais il peut certainement les rendre moins bonnes si vous choisissez le mauvais codec. L’important est de comprendre les détails de votre métrage original et de vous assurer que votre codec intermédiaire est au moins aussi bon que votre codec de capture dans chaque domaine. Si vous capturez votre métrage sur un reflex numérique comme le Sony A7Sii en 4K, vous enregistrerez dans un codec 4:2:0, 8 bits, Long-GOP à 100 Mbps. Vous voulez un codec intermédiaire qui soit au moins 4:2:0 et 8 bits. Aller au-delà de ces valeurs (par exemple en 4:4:4 et 12 bits) ne fera pas de mal, mais n’aidera pas non plus. Donc, cela ne vaut probablement pas la peine d’utiliser l’espace de stockage supplémentaire.

Disons, par exemple, que nous voulons opter pour un codec ProRes. Nous avons 4 options à choisir qui sont 4:2:2 et 10 bits.

- 145Mb/s ProRes 422 Proxy

- 328Mb/s ProRes 422 LT

- 471Mb/s ProRes 422

- 707Mb/s. ProRes 422 HQ

Supérieur et supérieur

Vous pourriez penser que tout ce dont vous avez besoin est de correspondre au débit de la caméra (100Mbps), mais vous devez en fait dépasser largement le débit de la caméra. Cela est dû au fait que le h.264 est un codec beaucoup plus efficace que le ProRes. Comme le h.264 utilise la compression long-GOP, il peut faire tenir beaucoup plus d’informations dans ces 100 mégabits que le ProRes. Pour que ProRes puisse égaler la qualité d’image du h.264, il faut un débit binaire beaucoup plus élevé. Je recommande d’utiliser uniquement ProRes 422 ou ProRes 422 HQ si vous commencez avec un codec h.264 de 100 Mbps. ProRes 422 fera probablement très bien l’affaire, mais si vous avez beaucoup d’espace de stockage, alors aller jusqu’à ProRes 422 HQ aura un léger avantage.

Si c’est bien de simplement faire correspondre la profondeur de bits et l’échantillonnage des couleurs lors du choix d’un intermédiaire, vous devriez toujours augmenter le débit binaire au moins un peu. Si vous passez d’un codec à GOP long à un codec à GOP non long, alors vous devriez augmenter le débit binaire beaucoup.

Note annexe : Si vous vouliez aller avec DNxHD au lieu de ProRes, vous avez des options similaires, sauf que DNxHD offre également une version 8 bits pour les codecs bas de gamme. Comme notre métrage est 8 bits au départ, cela ne nous fera pas du tout de mal.

Le workflow proxy semblait plutôt bon. Pourquoi faire le Direct Intermediate ?

Une partie de la raison pour laquelle le workflow Direct Intermediate est commun est qu’il était auparavant beaucoup plus difficile d’utiliser un workflow proxy. Certains des principaux fournisseurs de logiciels ne rendaient pas particulièrement facile de rétablir le lien avec les fichiers originaux de la caméra, et les gens choisissaient donc un flux de travail intermédiaire direct. Aujourd’hui, cependant, il est assez facile de le faire dans n’importe quel logiciel de montage. La principale exception est lorsque vous avez beaucoup de types de métrage mélangés. Si vous avez plusieurs fréquences et tailles d’images dans le même projet, le passage des proxies aux codecs de capture peut être un casse-tête.

Si vous utilisez certains outils tiers pour aider à préparer et organiser votre métrage avant de commencer le découpage, ceux-ci peuvent également rendre le processus de réassociation plus délicat. Un exemple courant pourrait être un logiciel qui synchronise automatiquement les pistes audio ou les tournages multicam.

Pas de permutation nécessaire

Une autre raison pour laquelle vous pourriez vouloir utiliser un workflow Direct Intermediate est que vous pouvez passer directement à la correction des couleurs et au processus VFX ( » finition « ) sans permuter aucun fichier. Continuez à lire, et j’expliquerai plus en détail pourquoi c’est pratique dans les sections Correction des couleurs et VFX.

Un inconvénient, cependant, est que vous ne pouvez pas « cuire » les LUT pour votre éditeur – vous allez devoir appliquer une LUT via un effet de correction des couleurs dans votre logiciel de montage. Si vous deviez inclure la LUT dans votre transcodage pour le workflow Direct Intermediate, vous perdriez tous les avantages de l’enregistrement en log en premier lieu.

L’autre inconvénient évident est que vous devez stocker tous ces fichiers (beaucoup plus volumineux).

Un codec intermédiaire ne rendra jamais vos images meilleures

(retour à l’index)

Ce point est très important, car il est très communément mal compris, et il y a beaucoup de désinformation en ligne. Transcoder votre métrage avant de le monter n’augmentera jamais la qualité de la sortie. Il y a quelques opérations supplémentaires que vous pourriez faire dans le processus de transcodage (comme l’utilisation d’outils up-res sophistiqués) qui pourraient augmenter la qualité de l’image dans certains cas, mais un nouveau codec en lui-même n’augmentera jamais la qualité de votre image.

Si vous choisissez le bon codec, vous pouvez éviter de nuire à votre image, mais vous ne pourrez jamais l’améliorer.

Cela inclut le passage de h.264 à DNxHD ou ProRes. Cela inclut également le passage de 8 bits à 10 bits. Et passer de 4:2:0 à 4:4:4.

Voici une illustration qui peut vous aider à comprendre ce concept :

C’est la photo d’une rose qui se reflète dans une goutte d’eau. C’est 4 mégapixels, et ça a l’air plutôt joli sur mon moniteur de 27 pouces.

Maintenant, et si je prenais une photo de mon moniteur avec un appareil photo Red Helium 8k. C’est une bête de caméra. J’ai pris la photo de la rose il y a quelques années avec un Canon Rebel DSLR bon marché, qui vaut environ 250 $ aujourd’hui. L’installation de l’Helium rouge coûte environ 50 000 $, elle est de 35 mégapixels, elle est brute, elle a l’un des meilleurs capteurs de caméra jamais produits.

Qu’est-ce qui sera une meilleure image – la photo de 4 mégapixels, ou la photo de 35 mégapixels ?

Une capture d’une capture

L’appareil photo rouge a plus de mégapixels, non ? Il est brut, et il a toute la magie numérique de Red, non ? Mais comme j’utilise mon appareil haute résolution pour prendre une photo de la photo, et non une photo de la rose, ma nouvelle image fantaisiste ne sera jamais meilleure que la première. J’ai un fichier qui est techniquement de plus haute résolution, mais il ne capture pas plus de mon sujet (la rose) que ne le faisait le premier.

C’est ce que vous faites lorsque vous transcoder. Vous faites une copie d’une copie, en prenant une photo d’une photo. Si vous utilisez un appareil photo haute résolution fantaisie pour prendre une photo d’une photo, vous serez en mesure de préserver à peu près toutes les informations de l’image originale, mais vous ne serez pas en mesure d’ajouter quoi que ce soit.

La grande mise en garde est que, si vous effectuez un traitement, une transformation de l’image (ajout d’une LUT, par exemple), alors vous voulez absolument transcoder dans un codec de meilleure qualité, qui conservera les nouvelles informations. Mais si vous ne modifiez pas l’image, alors le transcodage ne rendra pas votre image en quelque sorte « meilleure ». »

Un exemple concret

(retour à l’index)

Disons que vous montez un documentaire qui a capturé des séquences 4K à l’aide d’un appareil photo Sony A7sii, enregistrant dans la version long-GOP du XAVC-S. Ce n’est pas idéal pour le montage. S’ils ont tourné 40 heures de métrage pour votre documentaire long métrage, vous vous retrouveriez avec environ 2,7 To de fichiers de caméra, qui peuvent facilement tenir sur un seul disque dur (bien que vous ayez fait d’autres sauvegardes séparées, bien sûr !).

Vous pourriez convertir cela en un codec de haute qualité, sans perte de qualité, pour un workflow Direct Intermediate, peut-être ProRes 422 HQ en 4K.

L’inconvénient est que vous auriez besoin d’environ 12,7To afin de stocker que tous ces fichiers ProRes. Vous devriez utiliser une configuration RAID coûteuse afin d’avoir un accès facile à tout ce métrage dans un projet, au moins 1 000 $. Des cacahuètes pour une grande installation, mais un investissement important pour un monteur solo.

Choisir le proxy

Donc, vous pourriez décider d’utiliser plutôt un workflow Proxy et transcoder vos fichiers au format ProRes 422 Proxy 4K. Votre métrage ne prendrait alors que 2,8 To, soit à peine plus que votre métrage capturé. Vous pouvez alors facilement monter à partir d’un seul disque dur, et votre flux de travail devient beaucoup plus simple. (Pour savoir comment calculer les débits binaires et la taille des fichiers, consultez cet article : La formule simple pour calculer les bitrates vidéo).

Disons que vous travaillez avec un autre monteur qui se trouve à l’autre bout du pays. Vous pourriez décider de transcoder le métrage encore plus bas en ProRes 422 Proxy HD, ce qui réduirait votre métrage à seulement 640 Go, ce qui devient plus faisable pour envoyer sur Internet si vous avez une connexion rapide. (18 heures de téléchargement sur une connexion 80Mbps)

Une fois le montage terminé, il vous suffit de relier à nouveau votre projet aux fichiers originaux de la caméra et de l’exporter. Même si vous et votre monteur à distance avez travaillé dans un codec assez déficitaire, l’exportation finale le contourne, donc vous ne perdez aucune qualité.

Le codec que vous corrigez en couleur

(retour à l’index)

Ok, maintenant que vous avez monté votre vidéo, il est temps de procéder à la correction des couleurs. Tout ce dont nous parlons ici s’appliquera que vous corrigiez les couleurs à l’intérieur de votre application de montage, ou que vous envoyiez votre montage à un logiciel de correction des couleurs dédié.

La grande question à ce stade est de savoir si vous voulez corriger les couleurs directement sur les fichiers originaux de la caméra, ou si vous voulez transcoder. Si vous avez fait un montage proxy/offline, alors vous ne voulez certainement pas corriger les couleurs des fichiers proxy, car ils ont une qualité d’image inférieure. Pour prendre de bonnes décisions sur la couleur, vous avez besoin de l’image de la plus haute qualité dont vous disposez, parce que vous devez être capable de voir exactement ce avec quoi vous devez travailler.

Donc, nous devons travailler avec des images de haute qualité, et nous avons quelques options différentes :

A. Classer les fichiers de la caméra

C’est certainement une option simple. Si vous avez fait un montage par proxy, vous pouvez vous relier aux fichiers de la caméra pour le processus de finition et aller en ville. Cela vous donnera une qualité d’image maximale, mais vous vous souvenez que les fichiers de la caméra peuvent être lents à travailler ? Les fichiers de la caméra peuvent ralentir un peu le processus, mais en fonction du logiciel que vous utilisez et de la quantité de travail que vous devez effectuer, vous pouvez décider que la simplicité vaut bien un petit ralentissement potentiel. Si vous avez un montage court sans beaucoup de complexité, alors cela peut être un flux de travail excellent et facile.

Supposons que le ralentissement de la correction des couleurs vous dérange, vous avez donc besoin d’un codec plus facile à travailler. Vous pourriez transcoder tout votre métrage vers un codec de haute qualité d’image, créer un lien vers ces fichiers, puis commencer à faire votre correction des couleurs. Mais… cela va un peu à l’encontre de l’objectif d’un workflow proxy, n’est-ce pas ? Nous avons utilisé des proxys parce que nous ne voulions pas avoir à gérer les gros fichiers que cela créerait. Heureusement, il y a une autre option.

B. Consolider et transcoder

(retour à l’index)

Si vous avez utilisé un workflow proxy/offline pour le montage mais que vous ne voulez pas corriger les couleurs des fichiers de la caméra, une bonne option est de se relier aux fichiers de la caméra, de consolider votre projet puis de transcoder vers un codec haut de gamme.

Lorsque vous consolidez un projet, votre logiciel de montage fera une copie de votre projet ainsi qu’une copie du média, mais seulement les fichiers particuliers que vous avez fini par utiliser dans votre séquence. Ainsi, si vous avez tourné 7 prises mais que vous n’en avez utilisé qu’une seule dans le montage, le logiciel ne copiera que cette seule prise. Cela réduit considérablement l’espace de stockage, ce qui est très pratique à ce stade. Vous pouvez aussi consolider encore plus votre travail en ne conservant que les parties spécifiques de chaque prise que vous avez effectivement utilisées dans le montage, et en éliminant le reste. Dans ce cas, le logiciel inclura généralement quelques secondes avant et après chaque prise (appelées « handles »), au cas où vous voudriez ajouter un fondu ou un suivi de mouvement.

Démarrez votre grade

Maintenant, vous pouvez prendre ce nouveau projet consolidé (après avoir refait le lien avec les originaux) et transcoder tous ces fichiers vers un codec de très haute qualité et à haut débit, et commencer à corriger les couleurs. Cette méthode est différente du flux de travail Direct Intermediate, car vous ne transcoderez pas l’ensemble de votre métrage, mais uniquement celui qui a été intégré au montage final, qui peut représenter 1/20e ou 1/50e de la longueur du métrage que vous avez tourné à l’origine. Maintenant, cela ne semble pas si mal de transcoder vers un codec à haut débit parce que vous n’avez pas besoin d’en stocker autant. Même en ProRes 4444 4K, un long métrage ne représentera qu’environ 2 To – plutôt gérable.

Maintenant, vous pouvez terminer votre film avec des images de qualité supérieure et un traitement rapide, sur un disque dur qui tient dans votre poche. Woot!

C. Poursuivre le Direct Intermediate

La troisième option consiste à opter pour le workflow de montage Direct Intermediate, auquel cas vous êtes prêt à partir. Vous avez déjà transcodé tous vos fichiers vers un codec de haute qualité avant de commencer le montage, vous pouvez donc simplement continuer avec ces mêmes fichiers pour la correction des couleurs. C’est également pratique car ces fichiers sont bons à la fois pour le montage et pour la correction des couleurs et les VFX (voir ci-dessous).

Si vous remettez le projet à un coloriste ou un VFX externe, alors vous pouvez soit lui donner tout votre métrage de haute qualité (potentiellement ennuyeux en raison de la taille), soit utiliser la même astuce de consolidation que nous avons utilisée ci-dessus. Remettre le projet consolidé peut vous aider à avancer plus rapidement et à faire gagner du temps à votre coloriste également.

Un autre avantage

En plus de la simplicité du workflow Direct Intermediate (vous n’utilisez qu’un seul ensemble de fichiers), vous avez un autre avantage : les allers-retours entre le montage et la correction des couleurs sont plus simples.

Imaginez que vous avez terminé votre montage proxy – vous consolidez et transcodez, envoyez le tout à votre coloriste, puis décidez que vous devez apporter quelques modifications au montage. Vous devez alors retourner aux proxies pour effectuer le montage, puis consolider et envoyer à nouveau le métrage. Les mécanismes de ce processus peuvent être assez compliqués. Dans un flux de post-production haut de gamme, le montage est généralement « verrouillé » pour que les processus de finition puissent commencer. Cela signifie que (à moins que de mauvaises choses ne se produisent) vous ferez tout votre possible pour ne pas revenir en arrière et apporter des modifications au montage. Mais bon, les mauvaises choses arrivent, alors il vaut mieux être préparé.

Et maintenant nous trouvons une autre bonne raison pour un montage intermédiaire direct. Si vous allez faire une partie de votre travail de couleur et de votre travail de montage simultanément, ou au moins faire des allers-retours plusieurs fois, alors il peut être plus simple d’utiliser un seul codec pour les deux. C’est particulièrement pratique si vous effectuez votre montage et votre finition dans le même progiciel (ou ensemble de progiciels, par exemple Creative Cloud).

Le codec que vous envoyez à VFX

(retour à l’index)

Si vous effectuez un travail VFX, alors vous allez probablement devoir envoyer des fichiers à un autre programme (potentiellement une autre machine, pour un autre artiste). Si vous faites tout votre travail VFX dans votre éditeur (ce qui devient de plus en plus viable pour les travaux simples), alors vous pouvez sauter cette section. Utilisez simplement le même codec que celui que vous avez utilisé pour votre correction colorimétrique.

Pour la plupart d’entre nous, cependant, nous devons mettre en place un processus « aller-retour » qui envoie les clips de l’éditeur au logiciel VFX, puis de nouveau lorsqu’ils sont terminés. Cela se fait plan par plan, de sorte que vous n’envoyez pas la séquence entière au VFX, comme vous l’avez probablement fait pour l’étalonnage. La question de savoir à quel moment du processus vous envoyez vos plans au VFX dépend beaucoup du flux de travail particulier.

Certaines personnes enverront au VFX une fois le montage verrouillé et la correction des couleurs terminée, mais la pression du temps peut vous obliger à commencer à envoyer des plans avant.

Si vous effectuez le montage dans Premiere Pro et le VFX léger dans After Effects avec Dynamic Link, alors vous pouvez également sauter cette section. Dynamic Link fait automatiquement les allers-retours pour vous. Si vous réalisez beaucoup de travaux de VFX, vous pouvez tout de même utiliser les techniques de cette section, car Dynamic Link peut être un peu capricieux avec un trop grand nombre de projets. Adobe travaille toujours sur ces bugs, cependant, et donc c’est en partie un goût personnel.

Go big or go home

Dans le processus VFX, vous avez tendance à utiliser des codecs très haut de gamme (haut débit) pour deux raisons principales. La première est simplement que les artistes VFX ont besoin de toutes les informations que vous pouvez leur donner afin de bien faire leur travail. Les artistes VFX font partie des personnes les plus pointilleuses en matière de codecs, et ce pour une bonne raison. Tout le monde veut des images de haute qualité, mais les problèmes d’image peuvent souvent poser plus de problèmes pour les VFX que pour le montage, la correction des couleurs et l’exportation finale.

De nombreuses tâches dans le travail des VFX nécessitent une analyse très détaillée de l’image au niveau pixel par pixel, ce que la plupart des monteurs n’ont jamais besoin de faire. Par exemple, si vous faites une extraction sur écran vert, vous voulez que le bord entre votre personnage et l’écran vert soit aussi propre que possible. Nous avons tous vu d’affreux plans d’écran vert où les bords du personnage sont hachés ou flous. Ces problèmes sont souvent dus à des artefacts de compression d’image invisibles à l’œil nu. Le sous-échantillonnage couleur 4:2:2 ou 4:2:0, par exemple, n’a pratiquement aucun impact visible sur l’image. L’œil humain se préoccupe surtout du contraste et remarque rarement une faible résolution des couleurs, mais le processus d’extraction de l’écran vert repose essentiellement sur les valeurs chromatiques. Si le codec a jeté une grande partie des valeurs de couleur en utilisant le sous-échantillonnage chroma 4:2:0, une bonne clé de couleur peut être impossible.

Perte de génération

La deuxième raison pour laquelle vous voulez utiliser des codecs haut de gamme est la perte de génération. Dans le processus VFX, vous devrez probablement compresser votre fichier plusieurs fois. Vous compresserez le fichier une fois lorsque vous l’enverrez à eux. Ensuite, s’ils doivent transmettre le fichier à plusieurs spécialistes, ils peuvent le compresser deux ou trois fois avant de le renvoyer. Lorsqu’un fichier est compressé plusieurs fois, nous appelons cela une perte de génération multiple.

Si vous utilisez un codec bas de gamme, l’image se dégrade progressivement à chaque fois que vous la recompressez. L’un des grands avantages des codecs de très haute qualité est que vous pouvez les compresser plusieurs fois sans perdre beaucoup de qualité. Bien qu’il soit toujours préférable d’éviter de compresser une vidéo plusieurs fois, si vous utilisez des codecs de très haute qualité, vous êtes généralement assez bien loti.

Certains flux de travail VFX haut de gamme n’utiliseront que la compression sans perte pour cette raison. La bonne nouvelle est que vos plans VFX ne durent généralement que quelques secondes par clip, ce qui signifie que la taille de vos fichiers sera faible, même avec des codecs haut de gamme. Alors, allez-y à fond ! Si vous avez capturé du 4:4:4 dans la caméra, il faut absolument envoyer du 4:4:4 au VFX. Sinon, je choisirais un codec 4:2:2 haut de gamme (ProRes 422 HQ ou DNxHQX).

Et bien sûr, vous devez toujours communiquer au préalable avec le VFX sur le codec à envoyer. Si vous pensez qu’ils font un mauvais choix, envoyez-leur cet article 🙂

Le codec que vous exportez

(retour à l’index)

Maintenant que vous avez terminé le montage, la couleur et les VFX – vous êtes prêt à exporter. Vous ferez généralement l’exportation finale à partir du logiciel que vous avez utilisé pour la correction des couleurs, en utilisant le codec que vous avez utilisé dans le processus de correction des couleurs.

Si votre client est dans le domaine des médias, il devrait savoir quel codec il veut, donc vous pouvez sauter le reste de cette section !

Si votre client n’est pas un expert en vidéo, il peut ne pas savoir ce qu’il veut, vous devez donc prendre certaines décisions pour lui. La plupart du temps, votre client va vouloir une vidéo à télécharger sur YouTube et/ou d’autres sites de médias sociaux. Vous pourriez être tenté de choisir un codec qui est bon pour le streaming sur Internet. Mais vous auriez tort !

La raison : ces sites ne diffusent pas le même fichier que celui que vous téléchargez à vos spectateurs – ils compressent le fichier *encore* avant de le diffuser, et vous n’avez absolument aucun contrôle sur les paramètres qu’ils utilisent. Cela signifie que, si vous téléchargez un codec de faible qualité, nous nous retrouvons dans le scénario où nous prenons une photo de faible qualité d’une photo de faible qualité dont nous avons parlé. Mauvais ! À éviter !

Viser la meilleure qualité

En règle générale, si vous voulez un résultat de meilleure qualité, vous devez télécharger la source de meilleure qualité. Ils vont compresser à nouveau de toute façon, donc leur donner plus de données avec lesquelles travailler ne peut pas faire de mal, non ? Si vous disposez d’une connexion assez rapide, vous pouvez télécharger un ProRes 422. Certaines personnes ont signalé des résultats légèrement (seulement légèrement) meilleurs en téléchargeant ProRes au lieu du h.264 recommandé.

Si vous livrez un fichier à un client, pour qu’il le télécharge sur Youtube, alors je ne lui donnerais pas ProRes, car vous ne savez pas quel genre de bande passante il aura. Heureusement, ces sites ont tendance à publier les spécifications de téléchargement recommandées (il suffit de les chercher sur Google). Personnellement, je prendrai le débit binaire qu’ils recommandent et le multiplierai par environ 1,5x à 2x.

Votre client peut également vouloir un fichier qu’il peut intégrer directement dans son site Web (bien que je le dissuade, si vous le pouvez). De manière générale, vous voulez un h.264 très fortement compressé. Si vous êtes curieux de savoir ce qu’est un bon débit binaire, mon raisonnement est le suivant : si quelqu’un sait quel est le débit binaire idéal, c’est YouTube. Je télécharge périodiquement une vidéo de YouTube et vérifie son débit binaire, et je l’utilise comme point de référence.

Voir petit

Si la vidéo n’est pas publique, ils peuvent également vouloir un petit fichier qu’ils peuvent envoyer par courriel ou lier directement à leurs propres clients afin qu’ils puissent le télécharger. Dans ces cas, il peut être approprié de livrer plus de deux fichiers distincts, surtout s’il s’agit d’une longue vidéo. Le fichier qu’ils doivent télécharger sur YouTube sera trop volumineux pour être envoyé par courrier électronique. Dans ce cas, je vais généralement réduire la taille du fichier et le compresser très fortement. Vous devez également être réaliste et décider si vous pensez que votre client comprendra réellement la différence entre les deux fichiers.

Si je dois livrer plus d’un fichier, j’appellerai généralement l’un d’eux « HD » dans le nom du fichier et l’autre « petit » ou « pas HD » dans le nom du fichier. Si vous essayez de leur décrire les différents codecs, je peux presque garantir qu’ils auront oublié la différence d’ici la semaine prochaine, mais ils se souviendront probablement de ce que signifie HD et « not HD ».

Le codec que vous archivez

(retour à l’index)

Vous avez livré le(s) fichier(s) à votre client, alors maintenant vous pouvez vous asseoir et vous détendre… presque.

Comme tout professionnel travaillant dans cette industrie le sait, le jour où vous livrez le produit fini à votre client n’est souvent pas la dernière fois que vous touchez un projet. Parfois, un client veut revenir en arrière et changer quelque chose des semaines plus tard, ou il veut un codec de meilleure qualité, ou peut-être vous voulez l’ajouter à votre bobine personnelle. Dans tous ces cas, vous pouvez être passé à une autre machine ou à un autre logiciel, ce qui fait que c’est un casse-tête d’ouvrir le projet original et de le réexporter.

C’est pratique

C’est là qu’il est pratique d’avoir une grande archive du projet fini dans un codec de très haute qualité. Si votre client a demandé un codec de très haute qualité pour la livraison, alors vous êtes généralement prêt. Il suffit de conserver une copie de ce fichier, et tout va bien. Cependant, s’il a besoin d’un codec de livraison qui n’est pas de très haute qualité, il est toujours bon de faire votre propre exportation avec un codec sans perte ou aussi proche de la perte que vous pouvez vous le permettre, compte tenu de l’espace qu’il prendra. Je vais généralement exporter vers un codec 4:4:4 à très haut débit – soit DNxHD/HR, soit ProRes.

Vous avez des questions ? N’hésitez pas à commenter.

Je lis réellement tous les commentaires. Cet article est un travail en cours, et je vais le mettre à jour avec plus d’explications et d’exemples en fonction de vos commentaires. Si vous avez des commentaires privés ou des questions, envoyez-moi un courriel : david at frame dot io.

Vous voulez écrire pour le blog Frame.io ? Envoyez-moi un courriel : blog at frame dot io.

Merciements à Larry Jordan, Shane Ross et Philip Hodgetts pour leur contribution à cet article!